Metóda najmenších štvorcov je postavená na podmienke. Kde sa používa metóda najmenších štvorcov?

Metóda najmenších štvorcov je jednou z najbežnejších a najrozvinutejších vďaka jej jednoduchosť a efektívnosť metód na odhad parametrov lineárnych. Zároveň je potrebné dbať na istú opatrnosť pri jeho používaní, pretože modely s jeho pomocou nemusia spĺňať množstvo požiadaviek na kvalitu svojich parametrov a v dôsledku toho „nezodpovedajú“ vzorom vývoja procesov.

Pozrime sa podrobnejšie na postup odhadu parametrov lineárneho ekonometrického modelu metódou najmenších štvorcov. Takýto model vo všeobecnej forme môže byť reprezentovaný rovnicou (1.2):

yt = a 0 + a 1 x 1 t +...+ a n x nt + ε t.

Počiatočný údaj pri odhade parametrov a 0 , a 1 ,..., a n je vektor hodnôt závislej premennej r= (y 1 , y 2 , ... , y T)“ a matica hodnôt nezávislých premenných

v ktorom prvý stĺpec pozostávajúci z jednotiek zodpovedá koeficientu modelu .

Metóda najmenších štvorcov dostala svoj názov na základe základného princípu, že odhady parametrov získané na jej základe musia spĺňať: súčet štvorcov chyby modelu by mal byť minimálny.

Príklady riešenia úloh metódou najmenších štvorcov

Príklad 2.1. Obchodný podnik má sieť 12 predajní, o ktorých činnosti sú uvedené v tabuľke. 2.1.

Vedenie spoločnosti by chcelo vedieť, ako závisí veľkosť ročenky od predajnej plochy predajne.

Tabuľka 2.1

|

Číslo predajne |

Ročný obrat, milióny rubľov |

Obchodná plocha, tis. m2 |

Riešenie najmenších štvorcov. Označme - ročný obrat -tého obchodu, milióny rubľov; - predajná plocha predajne, tisíc m2.

Obr.2.1. Bodový graf pre príklad 2.1

Určiť formu funkčného vzťahu medzi premennými a zostrojiť bodový graf (obr. 2.1).

Na základe rozptylového diagramu môžeme konštatovať, že ročný obrat je pozitívne závislý od predajnej plochy (t.j. y sa zvýši s rastom o ). Najvhodnejšia forma funkčného spojenia je − lineárne.

Informácie pre ďalšie výpočty sú uvedené v tabuľke. 2.2. Pomocou metódy najmenších štvorcov odhadujeme parametre lineárneho jednofaktorového ekonometrického modelu

Tabuľka 2.2

teda

Preto so zvýšením obchodnej oblasti o 1 000 m 2, ak sú ostatné veci rovnaké, priemerný ročný obrat sa zvyšuje o 67,8871 milióna rubľov.

Príklad 2.2. Vedenie podniku si všimlo, že ročný obrat nezávisí len od predajnej plochy predajne (pozri príklad 2.1), ale aj od priemerného počtu návštevníkov. Príslušné informácie sú uvedené v tabuľke. 2.3.

Tabuľka 2.3

Riešenie. Označte - priemerný počet návštevníkov obchodu za deň, tisíc ľudí.

Určiť formu funkčného vzťahu medzi premennými a zostrojiť bodový graf (obr. 2.2).

Na základe rozptylového diagramu môžeme konštatovať, že ročný obrat pozitívne súvisí s priemerným počtom návštevníkov za deň (t. j. y sa bude zvyšovať s rastom o ). Forma funkčnej závislosti je lineárna.

Ryža. 2.2. Napríklad bodový graf 2.2

Tabuľka 2.4

Vo všeobecnosti je potrebné určiť parametre dvojfaktorového ekonometrického modelu

y t \u003d a 0 + a 1 x 1 t + a 2 x 2 t + ε t

Informácie potrebné pre ďalšie výpočty sú uvedené v tabuľke. 2.4.

Odhadnime parametre lineárneho dvojfaktorového ekonometrického modelu metódou najmenších štvorcov.

teda

Z vyhodnotenia koeficientu = 61,6583 vyplýva, že za rovnakých okolností pri zvýšení obchodnej plochy o 1 tisíc m 2 vzrastie ročný obrat v priemere o 61,6583 milióna rubľov.

Funkciu aproximujeme polynómom 2. stupňa. Na tento účel vypočítame koeficienty normálneho systému rovníc:

,  ,

,

Zostavme normálnu sústavu najmenších štvorcov, ktorá má tvar:

Riešenie systému je ľahké nájsť:, , .

Polynóm 2. stupňa sa teda nájde: .

Teoretické pozadie

Späť na stránku<Введение в вычислительную математику. Примеры>

Príklad 2. Nájdenie optimálneho stupňa polynómu.

Späť na stránku<Введение в вычислительную математику. Примеры>

Príklad 3. Odvodenie normálneho systému rovníc na nájdenie parametrov empirickej závislosti.

Odvoďme sústavu rovníc na určenie koeficientov a funkcií ![]() , ktorý vykonáva aproximáciu odmocniny danej funkcie vzhľadom na body. Zostavte funkciu

, ktorý vykonáva aproximáciu odmocniny danej funkcie vzhľadom na body. Zostavte funkciu ![]() a napíšte pre to nevyhnutnú extrémnu podmienku:

a napíšte pre to nevyhnutnú extrémnu podmienku:

Potom bude mať normálny systém podobu:

Získali sme lineárny systém rovníc pre neznáme parametre a, ktorý sa dá ľahko vyriešiť.

Teoretické pozadie

Späť na stránku<Введение в вычислительную математику. Примеры>

Príklad.

Experimentálne údaje o hodnotách premenných X A pri sú uvedené v tabuľke.

Výsledkom ich zosúladenia je funkcia ![]()

Použitím metóda najmenších štvorcov, aproximovať tieto údaje s lineárnou závislosťou y=ax+b(nájdite možnosti A A b). Zistite, ktorý z dvoch riadkov je lepší (v zmysle metódy najmenších štvorcov) zarovnáva experimentálne údaje. Urobte si kresbu.

Podstata metódy najmenších štvorcov (LSM).

Problémom je nájsť lineárne koeficienty závislosti, pre ktoré je funkcia dvoch premenných A A b![]() má najmenšiu hodnotu. Teda vzhľadom na dáta A A b súčet štvorcových odchýlok experimentálnych údajov od nájdenej priamky bude najmenší. Toto je celý zmysel metódy najmenších štvorcov.

má najmenšiu hodnotu. Teda vzhľadom na dáta A A b súčet štvorcových odchýlok experimentálnych údajov od nájdenej priamky bude najmenší. Toto je celý zmysel metódy najmenších štvorcov.

Riešenie príkladu sa teda redukuje na nájdenie extrému funkcie dvoch premenných.

Odvodenie vzorcov na hľadanie koeficientov.

Zostaví sa a vyrieši systém dvoch rovníc s dvoma neznámymi. Hľadanie parciálnych derivácií funkcií ![]() podľa premenných A A b, prirovnávame tieto deriváty k nule.

podľa premenných A A b, prirovnávame tieto deriváty k nule.

Výslednú sústavu rovníc riešime ľubovoľnou metódou (napr substitučná metóda alebo Cramerova metóda) a získajte vzorce na hľadanie koeficientov pomocou metódy najmenších štvorcov (LSM).

S údajmi A A b funkciu ![]() má najmenšiu hodnotu. Dôkaz o tejto skutočnosti je uvedený nižšie v texte na konci strany.

má najmenšiu hodnotu. Dôkaz o tejto skutočnosti je uvedený nižšie v texte na konci strany.

To je celá metóda najmenších štvorcov. Vzorec na nájdenie parametra a obsahuje súčty , , a parameter n je množstvo experimentálnych údajov. Hodnoty týchto súm sa odporúča vypočítať samostatne.

Koeficient b zistené po výpočte a.

Je čas pripomenúť si pôvodný príklad.

Riešenie.

V našom príklade n=5. Tabuľku vypĺňame pre pohodlie výpočtu súm, ktoré sú zahrnuté vo vzorcoch požadovaných koeficientov.

Hodnoty vo štvrtom riadku tabuľky sa získajú vynásobením hodnôt v 2. riadku hodnotami v 3. riadku pre každé číslo i.

Hodnoty v piatom riadku tabuľky sa získajú umocnením hodnôt v 2. riadku pre každé číslo i.

Hodnoty posledného stĺpca tabuľky sú súčty hodnôt v riadkoch.

Na zistenie koeficientov používame vzorce metódy najmenších štvorcov A A b. Nahradíme v nich zodpovedajúce hodnoty z posledného stĺpca tabuľky:

teda y = 0,165 x + 2,184 je požadovaná približná priamka.

Zostáva zistiť, ktorý z riadkov y = 0,165 x + 2,184 alebo ![]() lepšie aproximuje pôvodné údaje, t. j. urobiť odhad pomocou metódy najmenších štvorcov.

lepšie aproximuje pôvodné údaje, t. j. urobiť odhad pomocou metódy najmenších štvorcov.

Odhad chyby metódy najmenších štvorcov.

Aby ste to dosiahli, musíte vypočítať súčty štvorcových odchýlok pôvodných údajov z týchto riadkov ![]() A

A ![]() , menšia hodnota zodpovedá riadku, ktorý sa lepšie približuje pôvodným údajom z hľadiska metódy najmenších štvorcov.

, menšia hodnota zodpovedá riadku, ktorý sa lepšie približuje pôvodným údajom z hľadiska metódy najmenších štvorcov.

Od , potom riadok y = 0,165 x + 2,184 sa lepšie približuje pôvodným údajom.

Grafické znázornenie metódy najmenších štvorcov (LSM).

Na grafoch vyzerá všetko skvele. Červená čiara je nájdená čiara y = 0,165 x + 2,184, modrá čiara je ![]() , ružové bodky sú pôvodné údaje.

, ružové bodky sú pôvodné údaje.

Na čo to je, na čo sú všetky tieto aproximácie?

Osobne používam na riešenie problémov vyhladzovania údajov, interpolácie a extrapolácie (v pôvodnom príklade by ste mohli byť požiadaní, aby ste našli hodnotu pozorovanej hodnoty r pri x=3 alebo kedy x=6 podľa metódy MNC). Ale o tom si povieme viac neskôr v inej časti stránky.

Začiatok stránky

Dôkaz.

Takže keď sa nájde A A b funkcia nadobúda najmenšiu hodnotu, je potrebné, aby v tomto bode bola matica kvadratického tvaru diferenciálu druhého rádu pre funkciu ![]() bol pozitívny jednoznačný. Ukážme to.

bol pozitívny jednoznačný. Ukážme to.

Rozdiel druhého rádu má tvar:

Teda

Preto má matica kvadratickej formy tvar

a hodnoty prvkov nezávisia od A A b.

Ukážme, že matica je pozitívne definitívna. To si vyžaduje, aby uhol maloletých bol pozitívny.

Uhlová moll prvého rádu  . Nerovnosť je prísna, pretože body sa nezhodujú. To bude naznačené v nasledujúcom.

. Nerovnosť je prísna, pretože body sa nezhodujú. To bude naznačené v nasledujúcom.

Uhlová minor druhého rádu

Dokážme to  metóda matematickej indukcie.

metóda matematickej indukcie.

Záver: nájdené hodnoty A A b zodpovedajú najmenšej hodnote funkcie ![]() , preto sú požadované parametre pre metódu najmenších štvorcov.

, preto sú požadované parametre pre metódu najmenších štvorcov.

Rozumel si niekedy?

Objednajte si riešenie

Začiatok stránky

Vypracovanie prognózy metódou najmenších štvorcov. Príklad riešenia problému

Extrapolácia - ide o metódu vedeckého výskumu, ktorá je založená na šírení minulých a súčasných trendov, zákonitostí, vzťahov k budúcemu vývoju objektu prognózovania. Extrapolačné metódy zahŕňajú metóda kĺzavého priemeru, metóda exponenciálneho vyhladzovania, metóda najmenších štvorcov.

Esencia metóda najmenších štvorcov spočíva v minimalizácii súčtu kvadratických odchýlok medzi pozorovanými a vypočítanými hodnotami. Vypočítané hodnoty sa nachádzajú podľa zvolenej rovnice - regresnej rovnice. Čím menšia je vzdialenosť medzi skutočnými hodnotami a vypočítanými, tým presnejšia je predpoveď na základe regresnej rovnice.

Ako základ pre výber krivky slúži teoretický rozbor podstaty skúmaného javu, ktorého zmenu zobrazuje časový rad. Niekedy sa berú do úvahy úvahy o povahe rastu úrovní série. Ak sa teda rast produkcie očakáva v aritmetickej progresii, potom sa vyhladenie vykoná v priamke. Ak sa ukáže, že rast je exponenciálny, vyhladenie by sa malo vykonať podľa exponenciálnej funkcie.

Pracovný vzorec metódy najmenších štvorcov : Yt+1 = a*X + b, kde t + 1 je prognózované obdobie; Уt+1 – predpokladaný ukazovateľ; a a b sú koeficienty; X je symbolom času.

Koeficienty a a b sa vypočítajú podľa nasledujúcich vzorcov:

|

|

kde Uf - skutočné hodnoty série dynamiky; n je počet úrovní v časovom rade;

Vyhladzovanie časových radov metódou najmenších štvorcov slúži na vyjadrenie zákonitostí vývoja skúmaného javu. V analytickom vyjadrení trendu sa čas považuje za nezávislú premennú a úrovne série pôsobia ako funkcia tejto nezávislej premennej.

Vývoj javu nezávisí od toho, koľko rokov uplynulo od východiskového bodu, ale od toho, aké faktory ovplyvnili jeho vývoj, akým smerom a s akou intenzitou. Z toho je zrejmé, že vývoj javu v čase sa javí ako výsledok pôsobenia týchto faktorov.

Správne nastavenie typu krivky, typu analytickej závislosti na čase je jednou z najťažších úloh prediktívnej analýzy. .

Výber typu funkcie, ktorá popisuje trend, ktorého parametre sú určené metódou najmenších štvorcov, sa vo väčšine prípadov robí empiricky, zostrojením viacerých funkcií a ich vzájomným porovnaním pomocou hodnoty odmocniny. stredná štvorcová chyba vypočítaná podľa vzorca:

|

kde Uf - skutočné hodnoty série dynamiky; Ur – vypočítané (vyhladené) hodnoty časového radu; n je počet úrovní v časovom rade; p je počet parametrov definovaných vo vzorcoch popisujúcich trend (vývojový trend).

Nevýhody metódy najmenších štvorcov :

- pri pokuse o opísanie skúmaného ekonomického javu pomocou matematickej rovnice bude predpoveď presná na krátky čas a regresná rovnica by sa mala prepočítať, keď budú k dispozícii nové informácie;

- zložitosť výberu regresnej rovnice, ktorá je riešiteľná pomocou štandardných počítačových programov.

Príklad použitia metódy najmenších štvorcov na vytvorenie prognózy

Úloha . Existujú údaje charakterizujúce mieru nezamestnanosti v kraji, %

- Zostavte prognózu miery nezamestnanosti v regióne na mesiace november, december, január pomocou metód: kĺzavý priemer, exponenciálne vyhladzovanie, najmenšie štvorce.

- Vypočítajte chyby vo výsledných prognózach pomocou každej metódy.

- Porovnajte získané výsledky, urobte závery.

Riešenie najmenších štvorcov

Pre riešenie zostavíme tabuľku, v ktorej urobíme potrebné výpočty:

ε = 28,63/10 = 2,86 % presnosť predpovede vysoká.

Záver : Porovnanie výsledkov získaných vo výpočtoch metóda kĺzavého priemeru , exponenciálne vyhladzovanie a metódou najmenších štvorcov, môžeme povedať, že priemerná relatívna chyba vo výpočtoch metódou exponenciálneho vyhladzovania spadá do 20-50%. To znamená, že presnosť predpovede je v tomto prípade iba uspokojivá.

V prvom a treťom prípade je presnosť predpovede vysoká, pretože priemerná relatívna chyba je menšia ako 10 %. Metóda kĺzavého priemeru však umožnila získať spoľahlivejšie výsledky (predpoveď na november - 1,52%, predpoveď na december - 1,53%, predpoveď na január - 1,49%), pretože priemerná relatívna chyba pri použití tejto metódy je najmenšia - 1 ,13 %.

Metóda najmenších štvorcov

Ďalšie súvisiace články:

Zoznam použitých zdrojov

- Vedecké a metodické odporúčania k problematike diagnostiky sociálnych rizík a predpovedania výziev, hrozieb a sociálnych dôsledkov. Ruská štátna sociálna univerzita. Moskva. 2010;

- Vladimírová L.P. Prognózovanie a plánovanie v trhových podmienkach: Proc. príspevok. M.: Vydavateľstvo "Dashkov and Co", 2001;

- Novikova N.V., Pozdeeva O.G. Prognózovanie národného hospodárstva: Vzdelávacia a metodická príručka. Jekaterinburg: Vydavateľstvo Ural. štát hospodárstva univerzita, 2007;

- Slutskin L.N. Kurz MBA v oblasti obchodného prognózovania. Moskva: Alpina Business Books, 2006.

Program MNE

Zadajte údaje

Údaje a aproximácia y = a + b x

i- číslo experimentálneho bodu;

x i- hodnota pevného parametra v bode i;

y i- hodnota meraného parametra v bode i;

ω i- meranie hmotnosti v bode i;

y i, calc.- rozdiel medzi nameranou hodnotou a hodnotou vypočítanou z regresie r v bode i;

S x i (x i)- odhad chyby x i pri meraní r v bode i.

Údaje a aproximácia y = k x

| i | x i | y i | ω i | y i, calc. | Δy i | S x i (x i) |

|---|

Kliknite na graf

Používateľská príručka pre online program MNC.

Do dátového poľa zadajte do každého samostatného riadku hodnoty x a y v jednom experimentálnom bode. Hodnoty musia byť oddelené medzerou (medzerou alebo tabulátorom).

Treťou hodnotou môže byť bodová váha „w“. Ak bodová váha nie je určená, potom sa rovná jednej. V drvivej väčšine prípadov sú váhy experimentálnych bodov neznáme alebo nie sú vypočítané; všetky experimentálne údaje sa považujú za ekvivalentné. Niekedy váhy v študovanom rozsahu hodnôt určite nie sú ekvivalentné a možno ich dokonca vypočítať teoreticky. Napríklad v spektrofotometrii sa hmotnosti dajú vypočítať pomocou jednoduchých vzorcov, hoci to v podstate každý zanedbáva, aby znížil náklady na prácu.

Údaje je možné vložiť cez schránku z tabuľky kancelárskeho balíka, ako je Excel z balíka Microsoft Office alebo Calc z Open Office. Ak to chcete urobiť, v tabuľke vyberte rozsah údajov, ktoré chcete skopírovať, skopírujte ich do schránky a vložte údaje do údajového poľa na tejto stránke.

Na výpočet metódou najmenších štvorcov sú potrebné aspoň dva body na určenie dvoch koeficientov „b“ – tangens uhla sklonu priamky a „a“ – hodnoty odrezanej priamkou na „y“. ` os.

Pre odhad chyby vypočítaných regresných koeficientov je potrebné nastaviť počet experimentálnych bodov na viac ako dva.

Metóda najmenších štvorcov (LSM).

Čím väčší je počet experimentálnych bodov, tým je štatistický odhad koeficientov presnejší (v dôsledku poklesu Studentovho koeficientu) a čím je odhad bližšie k odhadu všeobecnej vzorky.

Získavanie hodnôt v každom experimentálnom bode je často spojené so značnými nákladmi na pracovnú silu, preto sa často vykonáva kompromisný počet experimentov, ktorý poskytuje stráviteľný odhad a nevedie k nadmerným nákladom na pracovnú silu. Počet experimentálnych bodov pre lineárnu závislosť najmenších štvorcov s dvoma koeficientmi sa spravidla volí v rozsahu 5-7 bodov.

Stručná teória najmenších štvorcov pre lineárnu závislosť

Predpokladajme, že máme súbor experimentálnych údajov vo forme párov hodnôt [`y_i`, `x_i`], kde `i` je číslo jedného experimentálneho merania od 1 do `n`; `y_i` – hodnota nameranej hodnoty v bode `i`; `x_i` – hodnota parametra, ktorý sme nastavili v bode `i`.

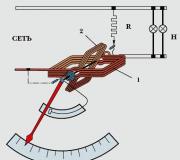

Príkladom je fungovanie Ohmovho zákona. Zmenou napätia (potenciálneho rozdielu) medzi úsekmi elektrického obvodu meriame množstvo prúdu prechádzajúceho týmto úsekom. Fyzika nám dáva experimentálne zistenú závislosť:

"I=U/R",

kde `I` - sila prúdu; `R` - odpor; "U" - napätie.

V tomto prípade je „y_i“ nameraná hodnota prúdu a „x_i“ je hodnota napätia.

Ako ďalší príklad uvažujme absorpciu svetla roztokom látky v roztoku. Chémia nám dáva vzorec:

"A = εl C",

kde "A" je optická hustota roztoku; "ε" - priepustnosť rozpustenej látky; `l` - dĺžka dráhy, keď svetlo prechádza kyvetou s roztokom; "C" je koncentrácia rozpustenej látky.

V tomto prípade je „y_i“ nameraná optická hustota „A“ a „x_i“ je koncentrácia látky, ktorú sme nastavili.

Budeme brať do úvahy prípad, keď je relatívna chyba v nastavení `x_i` oveľa menšia ako relatívna chyba v meraní `y_i`. Budeme tiež predpokladať, že všetky namerané hodnoty `y_i` sú náhodné a normálne rozdelené, t.j. dodržiavať zákon normálneho rozdelenia.

V prípade lineárnej závislosti `y` od `x` môžeme napísať teoretickú závislosť:

`y = a + bx`.

Z geometrického hľadiska koeficient „b“ označuje dotyčnicu uhla sklonu priamky k osi „x“ a koeficient „a“ - hodnotu „y“ v priesečníku čiara s osou y (pre x = 0).

Nájdenie parametrov regresnej priamky.

V experimente nemôžu namerané hodnoty `y_i` ležať presne na teoretickej línii kvôli chybám merania, ktoré sú v reálnom živote vždy vlastné. Preto musí byť lineárna rovnica reprezentovaná systémom rovníc:

`y_i = a + b x_i + ε_i` (1),

kde „ε_i“ je neznáma chyba merania „y“ v „i“ experimente.

Závislosť (1) sa tiež nazýva regresia, t.j. závislosť dvoch veličín na sebe so štatistickou významnosťou.

Úlohou obnovenia závislosti je nájsť koeficienty `a` a `b` z experimentálnych bodov [`y_i`, `x_i`].

Na nájdenie koeficientov sa zvyčajne používa „a“ a „b“. metóda najmenších štvorcov(MNK). Ide o špeciálny prípad princípu maximálnej pravdepodobnosti.

Prepíšme (1) ako `ε_i = y_i - a - b x_i`.

Potom bude súčet štvorcových chýb

`Φ = súčet_(i=1)^(n) ε_i^2 = súčet_(i=1)^(n) (y_i - a - b x_i)^2`. (2)

Princípom metódy najmenších štvorcov je minimalizovať súčet (2) vzhľadom na parametre "a" a "b"..

Minimum sa dosiahne, keď sa parciálne derivácie súčtu (2) vzhľadom na koeficienty „a“ a „b“ rovnajú nule:

`frac(čiastočné Φ)(čiastočné a) = frac(čiastočný súčet_(i=1)^(n) (y_i - a - b x_i)^2)(čiastočné a) = 0`

`frac(čiastočné Φ)(čiastočné b) = frac(čiastočný súčet_(i=1)^(n) (y_i - a - b x_i)^2)(čiastočné b) = 0`

Rozšírením derivácií dostaneme systém dvoch rovníc s dvoma neznámymi:

`sum_(i=1)^(n) (2a + 2bx_i - 2y_i) = sum_(i=1)^(n) (a + bx_i - y_i) = 0`

`sum_(i=1)^(n) (2bx_i^2 + 2ax_i - 2x_iy_i) = sum_(i=1)^(n) (bx_i^2 + ax_i - x_iy_i) = 0`

Otvoríme zátvorky a prenesieme súčty nezávislé od požadovaných koeficientov do druhej polovice, dostaneme systém lineárnych rovníc:

`sum_(i=1)^(n) y_i = a n + b suma_(i=1)^(n) bx_i`

`sum_(i=1)^(n) x_iy_i = súčet_(i=1)^(n) x_i + b súčet_(i=1)^(n) x_i^2`

Pri riešení výsledného systému nájdeme vzorce pre koeficienty „a“ a „b“:

`a = frac(sum_(i=1)^(n) y_i suma_(i=1)^(n) x_i^2 - suma_(i=1)^(n) x_i suma_(i=1)^(n ) x_iy_i) (n súčet_(i=1)^(n) x_i^2 — (súčet_(i=1)^(n) x_i)^2)“ (3.1)

`b = frac(n súčet_(i=1)^(n) x_iy_i - súčet_(i=1)^(n) x_i súčet_(i=1)^(n) y_i) (n súčet_(i=1)^ (n) x_i^2 - (sum_(i=1)^(n) x_i)^2)“ (3,2)

Tieto vzorce majú riešenia, keď `n > 1` (čiaru možno nakresliť pomocou najmenej 2 bodov) a keď determinant `D = n sum_(i=1)^(n) x_i^2 — (sum_(i= 1) )^(n) x_i)^2 != 0`, t.j. keď sú body x_i v experimente odlišné (t. j. keď čiara nie je vertikálna).

Odhad chýb v koeficientoch regresnej priamky

Pre presnejší odhad chyby pri výpočte koeficientov „a“ a „b“ je žiaduci veľký počet experimentálnych bodov. Keď `n = 2`, nie je možné odhadnúť chybu koeficientov, pretože aproximačná čiara bude jednoznačne prechádzať cez dva body.

Určí sa chyba náhodnej premennej `V` zákon akumulácie chýb

`S_V^2 = súčet_(i=1)^p (frac(čiastočné f)(čiastočné z_i))^2 S_(z_i)^2`,

kde `p` je počet parametrov `z_i` s chybou `S_(z_i)`, ktoré ovplyvňujú chybu `S_V`;

`f` je funkcia závislosti `V` na `z_i`.

Napíšme zákon akumulácie chýb pre chybu koeficientov `a` a `b`

`S_a^2 = súčet_(i=1)^(n)(frac(čiastočné a)(čiastočné y_i))^2 S_(y_i)^2 + súčet_(i=1)^(n)(frac(čiastočné a) )(čiastočné x_i))^2 S_(x_i)^2 = S_y^2 súčet_(i=1)^(n)(frac(čiastočné a)(čiastočné y_i))^2 `,

`S_b^2 = súčet_(i=1)^(n)(frac(čiastočné b)(čiastočné y_i))^2 S_(y_i)^2 + súčet_(i=1)^(n)(frac(čiastočné b) )(čiastočné x_i))^2 S_(x_i)^2 = S_y^2 súčet_(i=1)^(n)(frac(čiastočné b)(čiastočné y_i))^2 `,

pretože `S_(x_i)^2 = 0` (predtým sme urobili výhradu, že chyba `x` je zanedbateľná).

`S_y^2 = S_(y_i)^2` – chyba (rozptyl, druhá mocnina štandardnej odchýlky) v dimenzii y za predpokladu, že chyba je jednotná pre všetky hodnoty y.

Dosadením vzorcov na výpočet `a` a `b` do výsledných výrazov dostaneme

`S_a^2 = S_y^2 frac(sum_(i=1)^(n) (sum_(i=1)^(n) x_i^2 - x_i sum_(i=1)^(n) x_i)^2 ) (D^2) = S_y^2 frac((n súčet_(i=1)^(n) x_i^2 - (súčet_(i=1)^(n) x_i)^2) súčet_(i=1) ^(n) x_i^2) (D^2) = S_y^2 frac(sum_(i=1)^(n) x_i^2) (D)` (4,1)

`S_b^2 = S_y^2 frac(sum_(i=1)^(n) (n x_i - suma_(i=1)^(n) x_i)^2) (D^2) = S_y^2 frac( n (n súčet_(i=1)^(n) x_i^2 - (súčet_(i=1)^(n) x_i)^2)) (D^2) = S_y^2 frac(n) (D) (4.2)

Vo väčšine skutočných experimentov sa hodnota „Sy“ nemeria. Na to je potrebné vykonať niekoľko paralelných meraní (experimentov) v jednom alebo viacerých bodoch plánu, čo zvyšuje čas (a prípadne náklady) experimentu. Preto sa zvyčajne predpokladá, že odchýlku `y` od regresnej priamky možno považovať za náhodnú. Odhad rozptylu „y“ sa v tomto prípade vypočíta podľa vzorca.

`S_y^2 = S_(y, zvyšok)^2 = frac(sum_(i=1)^n (y_i - a - b x_i)^2) (n-2)`.

Deliteľ `n-2` sa objavuje, pretože sme znížili počet stupňov voľnosti v dôsledku výpočtu dvoch koeficientov pre rovnakú vzorku experimentálnych údajov.

Tento odhad sa tiež nazýva reziduálny rozptyl vo vzťahu k regresnej priamke `S_(y, zvyšok)^2`.

Hodnotenie významnosti koeficientov sa vykonáva podľa kritéria študenta

`t_a = frac(|a|) (S_a)`, `t_b = frac(|b|) (S_b)`

Ak sú vypočítané kritériá `t_a`, `t_b` menšie ako kritériá tabuľky `t(P, n-2)`, potom sa predpokladá, že zodpovedajúci koeficient sa pri danej pravdepodobnosti `P` významne nelíši od nuly.

Ak chcete posúdiť kvalitu popisu lineárneho vzťahu, môžete porovnať `S_(y, zvyšok)^2` a `S_(bar y)` relatívne k priemeru pomocou Fisherovho kritéria.

`S_(bar y) = frac(sum_(i=1)^n (y_i - bar y)^2) (n-1) = frac(sum_(i=1)^n (y_i - (sum_(i=) 1)^n y_i) /n)^2) (n-1)` - výberový odhad rozptylu `y` vo vzťahu k priemeru.

Na vyhodnotenie účinnosti regresnej rovnice na opis závislosti sa vypočíta Fisherov koeficient

`F = S_(pruh y) / S_(y, zvyšok)^2`,

ktorý sa porovnáva s tabuľkovým Fisherovým koeficientom "F(p, n-1, n-2)".

Ak `F > F(P, n-1, n-2)`, rozdiel medzi popisom závislosti `y = f(x)` pomocou regresnej rovnice a popisom pomocou priemeru sa považuje za štatisticky významný s pravdepodobnosťou "P". Tie. regresia popisuje závislosť lepšie ako rozptyl `y` okolo priemeru.

Kliknite na graf

pridať hodnoty do tabuľky

Metóda najmenších štvorcov. Metóda najmenších štvorcov znamená určenie neznámych parametrov a, b, c, akceptovanej funkčnej závislosti

Metóda najmenších štvorcov znamená určenie neznámych parametrov a, b, c,… akceptovaná funkčná závislosť

y = f(x,a,b,c,...),

ktorý by poskytol minimum strednej štvorce (rozptyl) chyby

, (24)

, (24)

kde x i , y i - množina dvojíc čísel získaných z experimentu.

Keďže podmienkou pre extrém funkcie viacerých premenných je podmienka, že jej parciálne derivácie sú rovné nule, potom parametre a, b, c,… sú určené zo sústavy rovníc:

; ; ; … (25)

Je potrebné mať na pamäti, že metóda najmenších štvorcov sa používa na výber parametrov za tvarom funkcie y = f(x) definované.

Ak z teoretických úvah nie je možné vyvodiť závery o tom, aký by mal byť empirický vzorec, potom sa treba riadiť vizuálnymi reprezentáciami, predovšetkým grafickým znázornením pozorovaných údajov.

V praxi sa najčastejšie obmedzuje na tieto typy funkcií:

1) lineárne ![]() ;

;

2) kvadratický a .

Výber typu regresnej funkcie, t.j. typ uvažovaného modelu závislosti Y na X (alebo X na Y), napríklad lineárny model y x = a + bx, je potrebné určiť konkrétne hodnoty koeficientov modelu.

Pre rôzne hodnoty a a b je možné zostrojiť nekonečný počet závislostí tvaru y x =a+bx, t.j. na rovine súradníc je nekonečný počet čiar, ale potrebujeme takú závislosť, aby čo najlepšie zodpovedá pozorovaným hodnotám. Problém sa teda redukuje na výber najlepších koeficientov.

Hľadáme lineárnu funkciu a + bx, založenú len na určitom počte dostupných pozorovaní. Na nájdenie funkcie, ktorá najlepšie zodpovedá pozorovaným hodnotám, používame metódu najmenších štvorcov.

Označme: Y i - hodnotu vypočítanú rovnicou Y i =a+bx i . y i - nameraná hodnota, ε i =y i -Y i - rozdiel medzi nameranými a vypočítanými hodnotami, ε i =y i -a-bx i.

Metóda najmenších štvorcov vyžaduje, aby ε i, rozdiel medzi nameraným y i a hodnotami Y i vypočítanými z rovnice, bol minimálny. Preto nájdeme koeficienty a a b tak, aby súčet druhých mocnín odchýlok pozorovaných hodnôt od hodnôt na priamej regresnej čiare bol najmenší:

Skúmaním tejto funkcie argumentov a a pomocou derivácií do extrému môžeme dokázať, že funkcia nadobúda minimálnu hodnotu, ak sú koeficienty a a b riešeniami sústavy:

(2)

(2)

Ak obe strany normálnych rovníc vydelíme n, dostaneme:

Vzhľadom na to  (3)

(3)

Získajte  , odtiaľ dosadením hodnoty a v prvej rovnici dostaneme:

, odtiaľ dosadením hodnoty a v prvej rovnici dostaneme:

V tomto prípade sa b nazýva regresný koeficient; a sa nazýva voľný člen regresnej rovnice a vypočíta sa podľa vzorca:

Výsledná priamka je odhadom pre teoretickú regresnú priamku. Máme:

takže, ![]() je lineárna regresná rovnica.

je lineárna regresná rovnica.

Regresia môže byť priama (b>0) a inverzná (b Príklad 1. Výsledky merania hodnôt X a Y sú uvedené v tabuľke:

| x i | -2 | 0 | 1 | 2 | 4 |

| y i | 0.5 | 1 | 1.5 | 2 | 3 |

Za predpokladu, že medzi X a Y existuje lineárny vzťah y=a+bx, určte koeficienty a a b pomocou metódy najmenších štvorcov.

Riešenie. Tu n=5

x i = -2+0+1+2+4=5;

x i2 = 4+0+1+4+16=25

x i y i =-2 0,5+0 1+1 1,5+2 2+4 3=16,5

yi = 0,5 + 1 + 1,5 + 2 + 3 = 8

a normálny systém (2) má tvar ![]()

Vyriešením tejto sústavy dostaneme: b=0,425, a=1,175. Preto y=1,175+0,425x.

Príklad 2. Existuje vzorka 10 pozorovaní ekonomických ukazovateľov (X) a (Y).

| x i | 180 | 172 | 173 | 169 | 175 | 170 | 179 | 170 | 167 | 174 |

| y i | 186 | 180 | 176 | 171 | 182 | 166 | 182 | 172 | 169 | 177 |

Je potrebné nájsť vzorovú regresnú rovnicu Y na X. Zostrojiť vzorovú regresnú priamku Y na X.

Riešenie. 1. Zoraďme údaje podľa hodnôt x i a y i . Dostávame novú tabuľku:

| x i | 167 | 169 | 170 | 170 | 172 | 173 | 174 | 175 | 179 | 180 |

| y i | 169 | 171 | 166 | 172 | 180 | 176 | 177 | 182 | 182 | 186 |

Pre zjednodušenie výpočtov zostavíme výpočtovú tabuľku, do ktorej zadáme potrebné číselné hodnoty.

| x i | y i | x i 2 | x i y i |

| 167 | 169 | 27889 | 28223 |

| 169 | 171 | 28561 | 28899 |

| 170 | 166 | 28900 | 28220 |

| 170 | 172 | 28900 | 29240 |

| 172 | 180 | 29584 | 30960 |

| 173 | 176 | 29929 | 30448 |

| 174 | 177 | 30276 | 30798 |

| 175 | 182 | 30625 | 31850 |

| 179 | 182 | 32041 | 32578 |

| 180 | 186 | 32400 | 33480 |

| ∑x i = 1729 | ∑y i = 1761 | ∑x i 2 299105 | ∑x i y i =304696 |

| x = 172,9 | y = 176,1 | x i2 = 29910,5 | xy=30469,6 |

Podľa vzorca (4) vypočítame regresný koeficient

a podľa vzorca (5)

Vzorová regresná rovnica teda vyzerá ako y=-59,34+1,3804x.

Vynesme body (x i ; y i) na súradnicovú rovinu a označme regresnú priamku.

Obr

Obrázok 4 ukazuje, ako sú pozorované hodnoty umiestnené vzhľadom na regresnú čiaru. Na numerický odhad odchýlok y i od Y i, kde y i sú pozorované hodnoty a Y i sú hodnoty určené regresiou, vytvoríme tabuľku:

| x i | y i | Y i | Y i -y i |

| 167 | 169 | 168.055 | -0.945 |

| 169 | 171 | 170.778 | -0.222 |

| 170 | 166 | 172.140 | 6.140 |

| 170 | 172 | 172.140 | 0.140 |

| 172 | 180 | 174.863 | -5.137 |

| 173 | 176 | 176.225 | 0.225 |

| 174 | 177 | 177.587 | 0.587 |

| 175 | 182 | 178.949 | -3.051 |

| 179 | 182 | 184.395 | 2.395 |

| 180 | 186 | 185.757 | -0.243 |

Hodnoty Y i sa vypočítajú podľa regresnej rovnice.

Znateľná odchýlka niektorých pozorovaných hodnôt od regresnej priamky sa vysvetľuje malým počtom pozorovaní. Pri štúdiu stupňa lineárnej závislosti Y na X sa berie do úvahy počet pozorovaní. Sila závislosti je určená hodnotou korelačného koeficientu.

Metóda najmenších štvorcov sa používa na odhad parametrov regresnej rovnice.Jednou z metód na štúdium stochastických vzťahov medzi znakmi je regresná analýza.

Regresná analýza je odvodením regresnej rovnice, ktorá sa používa na nájdenie priemernej hodnoty náhodnej premennej (vlastnosti-výsledku), ak je známa hodnota inej (alebo iných) premenných (vlastnostných faktorov). Zahŕňa nasledujúce kroky:

- voľba formy spojenia (typ analytickej regresnej rovnice);

- odhad parametrov rovnice;

- hodnotenie kvality analytickej regresnej rovnice.

V prípade lineárneho párového vzťahu bude mať regresná rovnica tvar: y i =a+b·x i +u i. Parametre tejto rovnice a a b sú odhadnuté z údajov štatistického pozorovania x a y . Výsledkom takéhoto hodnotenia je rovnica: , kde , - odhady parametrov a a b , - hodnota efektívnej vlastnosti (premennej) získaná regresnou rovnicou (vypočítaná hodnota).

Na odhad parametrov sa najčastejšie používa metóda najmenších štvorcov (LSM).

Metóda najmenších štvorcov poskytuje najlepšie (konzistentné, efektívne a nezaujaté) odhady parametrov regresnej rovnice. Ale iba ak sú splnené určité predpoklady o náhodnom člene (u) a nezávislej premennej (x) (pozri predpoklady OLS).

Problém odhadu parametrov lineárnej párovej rovnice metódou najmenších štvorcov spočíva v nasledujúcom: získať také odhady parametrov, pri ktorých je súčet druhých mocnín odchýlok skutočných hodnôt efektívnej funkcie - y i od vypočítaných hodnôt - minimálny.

Formálne Kritérium OLS dá sa napísať takto:  .

.

Klasifikácia metód najmenších štvorcov

- Metóda najmenších štvorcov.

- Metóda maximálnej pravdepodobnosti (pre normálny klasický lineárny regresný model sa postuluje normalita regresných zvyškov).

- Zovšeobecnená metóda najmenších štvorcov GLSM sa používa v prípade autokorelácie chýb a v prípade heteroskedasticity.

- Metóda vážených najmenších štvorcov (špeciálny prípad GLSM s heteroskedastickými rezíduami).

Ilustrujte podstatu graficky klasická metóda najmenších štvorcov. Aby sme to dosiahli, zostavíme bodový graf podľa pozorovacích údajov (x i, y i, i=1;n) v pravouhlom súradnicovom systéme (takýto bodový graf sa nazýva korelačné pole). Skúsme nájsť priamku, ktorá je najbližšie k bodom korelačného poľa. Podľa metódy najmenších štvorcov sa čiara volí tak, aby súčet štvorcových vertikálnych vzdialeností medzi bodmi korelačného poľa a touto čiarou bol minimálny.

Matematický zápis tohto problému:  .

.

Hodnoty y i a x i = 1...n sú nám známe, ide o pozorovacie údaje. Vo funkcii S sú konštanty. Premenné v tejto funkcii sú požadované odhady parametrov - , . Na nájdenie minima funkcie 2 premenných je potrebné vypočítať parciálne derivácie tejto funkcie vzhľadom na každý z parametrov a prirovnať ich k nule, t.j.  .

.

Výsledkom je systém 2 normálnych lineárnych rovníc:

Pri riešení tohto systému nájdeme požadované odhady parametrov:

Správnosť výpočtu parametrov regresnej rovnice je možné skontrolovať porovnaním súčtov (je možná určitá nezrovnalosť v dôsledku zaokrúhľovania výpočtov).

Ak chcete vypočítať odhady parametrov, môžete zostaviť tabuľku 1.

Znamienko regresného koeficientu b udáva smer vzťahu (ak b > 0, vzťah je priamy, ak b<0, то связь обратная). Величина b показывает на сколько единиц изменится в среднем признак-результат -y при изменении признака-фактора - х на 1 единицу своего измерения.

Formálne je hodnota parametra a priemerná hodnota y pre x rovná nule. Ak znamienkový faktor nemá a nemôže mať nulovú hodnotu, potom vyššie uvedená interpretácia parametra a nemá zmysel.

Posúdenie tesnosti vzťahu medzi znakmi

sa vykonáva pomocou koeficientu lineárnej párovej korelácie - r x,y . Dá sa vypočítať pomocou vzorca:  . Okrem toho možno koeficient lineárnej párovej korelácie určiť pomocou regresného koeficientu b:

. Okrem toho možno koeficient lineárnej párovej korelácie určiť pomocou regresného koeficientu b:  .

.

Rozsah prípustných hodnôt lineárneho koeficientu párovej korelácie je od –1 do +1. Znamienko korelačného koeficientu udáva smer vzťahu. Ak r x, y > 0, potom je spojenie priame; ak r x, y<0, то связь обратная.

Ak je tento koeficient blízky jednotke v module, potom vzťah medzi znakmi možno interpretovať ako pomerne blízky lineárny. Ak sa jeho modul rovná jednej ê r x , y ê =1, potom je vzťah medzi vlastnosťami funkčný lineárny. Ak sú znaky x a y lineárne nezávislé, potom r x, y je blízko 0.

Tabuľku 1 možno použiť aj na výpočet r x, y.

Na posúdenie kvality získanej regresnej rovnice sa vypočíta teoretický koeficient determinácie - R 2 yx:  ,

,

kde d2 je rozptyl y vysvetlený regresnou rovnicou;

e 2 - reziduálny (nevysvetlený regresnou rovnicou) rozptyl y ;

s 2 r - celkový (celkový) rozptyl y .

Koeficient determinácie charakterizuje podiel variácie (disperzie) výsledného znaku y, vysvetleného regresiou (a následne faktorom x), na celkovej variácii (disperzii) y. Koeficient determinácie R 2 yx nadobúda hodnoty od 0 do 1. Hodnota 1-R 2 yx teda charakterizuje podiel rozptylu y spôsobený vplyvom iných faktorov nezohľadnených v modeli a špecifikačných chýb.

Pri párovej lineárnej regresii R 2 yx = r 2 yx .

Metóda najmenších štvorcov

Metóda najmenších štvorcov ( MNK, OLS, Obyčajné najmenšie štvorce) - jedna zo základných metód regresnej analýzy na odhadovanie neznámych parametrov regresných modelov zo vzorových údajov. Metóda je založená na minimalizácii súčtu štvorcov regresných zvyškov.

Treba poznamenať, že samotnú metódu najmenších štvorcov možno nazvať metódou riešenia problému v akejkoľvek oblasti, ak riešenie pozostáva z alebo spĺňa určité kritérium na minimalizáciu súčtu druhých mocnín niektorých funkcií neznámych premenných. Preto možno metódu najmenších štvorcov použiť aj na približnú reprezentáciu (aproximáciu) danej funkcie inými (jednoduchšími) funkciami, pri hľadaní množiny veličín vyhovujúcich rovniciam alebo obmedzeniam, ktorých počet presahuje počet týchto veličín. , atď.

Podstata MNC

Nech nejaký (parametrický) model pravdepodobnostnej (regresnej) závislosti medzi (vysvetlenou) premennou r a mnoho faktorov (vysvetľujúce premenné) X

kde je vektor neznámych parametrov modelu

- Náhodná chyba modelu.Nech sú aj vzorové pozorovania hodnôt uvedených premenných. Nech je číslo pozorovania (). Potom sú to hodnoty premenných v -tom pozorovaní. Potom pre dané hodnoty parametrov b je možné vypočítať teoretické (modelové) hodnoty vysvetlenej premennej y:

Hodnota zvyškov závisí od hodnôt parametrov b.

Podstatou LSM (obyčajného, klasického) je nájsť také parametre b, pre ktoré je súčet štvorcov rezíduí (angl. Zvyšný súčet štvorcov) bude minimálny:

Vo všeobecnom prípade možno tento problém vyriešiť numerickými metódami optimalizácie (minimalizácie). V tomto prípade sa hovorí o nelineárne najmenšie štvorce(NLS alebo NLLS - anglicky. Nelineárne najmenšie štvorce). V mnohých prípadoch je možné získať analytické riešenie. Na vyriešenie úlohy minimalizácie je potrebné nájsť stacionárne body funkcie tak, že ju derivujeme vzhľadom na neznáme parametre b, derivácie priradíme k nule a vyriešime výslednú sústavu rovníc:

Ak sú náhodné chyby modelu normálne rozdelené, majú rovnaký rozptyl a nie sú navzájom korelované, odhady parametrov najmenších štvorcov sú rovnaké ako odhady metódy maximálnej pravdepodobnosti (MLM).

LSM v prípade lineárneho modelu

Nech je regresná závislosť lineárna:

Nechaj r- stĺpcový vektor pozorovaní vysvetľovanej premennej a - matica pozorovaní faktorov (riadky matice - vektory hodnôt faktorov v danom pozorovaní, po stĺpcoch - vektor hodnôt daného faktora vo všetkých pozorovaniach) . Maticová reprezentácia lineárneho modelu má tvar:

Potom sa vektor odhadov vysvetľovanej premennej a vektor regresných zvyškov budú rovnať

podľa toho sa súčet druhých mocnín regresných zvyškov bude rovnať

Diferencovaním tejto funkcie vzhľadom na vektor parametra a prirovnaním derivácií k nule dostaneme systém rovníc (v maticovom tvare):

.Riešenie tohto systému rovníc dáva všeobecný vzorec pre odhady najmenších štvorcov pre lineárny model:

Na analytické účely sa ukazuje ako užitočné posledné znázornenie tohto vzorca. Ak údaje v regresnom modeli vycentrované, potom v tomto znázornení má prvá matica význam výberovej kovariančnej matice faktorov a druhá je vektorom kovariancií faktorov so závislou premennou. Ak je navyše údaj aj normalizované na SKO (teda v konečnom dôsledku štandardizované), potom prvá matica má význam výberová korelačná matica faktorov, druhý vektor - vektor výberových korelácií faktorov so závislou premennou.

Dôležitá vlastnosť odhadov LLS pre modely s konštantou- priamka zostrojenej regresie prechádza ťažiskom vzorových údajov, to znamená, že rovnosť je splnená:

Najmä v extrémnom prípade, keď jediným regresorom je konštanta, zistíme, že odhad OLS jedného parametra (samotnej konštanty) sa rovná strednej hodnote vysvetľovanej premennej. To znamená, že aritmetický priemer, známy svojimi dobrými vlastnosťami zo zákonov veľkých čísel, je tiež odhadom najmenších štvorcov - spĺňa kritérium pre minimálny súčet odchýlok na druhú od neho.

Príklad: jednoduchá (párová) regresia

V prípade párovej lineárnej regresie sú výpočtové vzorce zjednodušené (zaobídete sa aj bez maticovej algebry):

Vlastnosti odhadov OLS

V prvom rade si všimneme, že pre lineárne modely sú odhady najmenších štvorcov lineárne odhady, ako vyplýva z vyššie uvedeného vzorca. Pre nestranné odhady OLS je potrebné a postačujúce splniť najdôležitejšiu podmienku regresnej analýzy: matematické očakávanie náhodnej chyby podmienenej faktormi sa musí rovnať nule. Táto podmienka je splnená najmä vtedy, ak

- matematické očakávanie náhodných chýb je nulové a

- faktory a náhodné chyby sú nezávislé náhodné premenné.

Druhá podmienka – podmienka exogénnych faktorov – je zásadná. Ak táto vlastnosť nie je splnená, potom môžeme predpokladať, že takmer všetky odhady budú extrémne neuspokojivé: dokonca nebudú konzistentné (to znamená, že ani veľmi veľké množstvo údajov v tomto prípade neumožňuje získať kvalitatívne odhady). V klasickom prípade sa silnejšie predpokladá determinizmus faktorov, na rozdiel od náhodnej chyby, ktorá automaticky znamená, že exogénna podmienka je splnená. Vo všeobecnosti pre konzistentnosť odhadov stačí splniť podmienku exogenity spolu s konvergenciou matice k nejakej nesingulárnej matici s nárastom veľkosti vzorky do nekonečna.

Aby boli okrem konzistentnosti a nezaujatosti efektívne aj odhady (zvyčajných) najmenších štvorcov (najlepšie v triede lineárnych neskreslených odhadov), je potrebné splniť ďalšie vlastnosti náhodnej chyby:

Tieto predpoklady možno formulovať pre kovariančnú maticu vektora náhodnej chyby

Lineárny model, ktorý tieto podmienky spĺňa, sa nazýva tzv klasický. Odhady OLS pre klasickú lineárnu regresiu sú nezaujaté, konzistentné a najefektívnejšie odhady v triede všetkých lineárnych neskreslených odhadov (v anglickej literatúre sa niekedy používa skratka Modrá (Najlepší lineárny nezaložený odhad) je najlepší lineárny nezaujatý odhad; v domácej literatúre sa častejšie uvádza Gauss-Markovova veta). Ako je ľahké ukázať, kovariančná matica vektora odhadov koeficientov sa bude rovnať:

Zovšeobecnené najmenšie štvorce

Metóda najmenších štvorcov umožňuje široké zovšeobecnenie. Namiesto minimalizovania súčtu štvorcov rezíduí je možné minimalizovať nejakú kladne definitívnu kvadratickú formu reziduálneho vektora , kde je nejaká symetrická kladne definitná váhová matica. Obyčajné najmenšie štvorce sú špeciálnym prípadom tohto prístupu, keď je matica váh úmerná matici identity. Ako je známe z teórie symetrických matíc (alebo operátorov), pre takéto matice existuje rozklad. Preto môže byť špecifikovaný funkcionál reprezentovaný nasledovne, to znamená, že tento funkcionál môže byť reprezentovaný ako súčet druhých mocnín niektorých transformovaných "zvyškov". Môžeme teda rozlíšiť triedu metód najmenších štvorcov – LS-metód (Least Squares).

Je dokázané (Aitkenova veta), že pre zovšeobecnený lineárny regresný model (v ktorom nie sú kladené žiadne obmedzenia na kovariančnú maticu náhodných chýb) sú najefektívnejšie (v triede lineárnych neskreslených odhadov) odhady tzv. zovšeobecnené OLS (OMNK, GLS - Generalized Least Squares)- LS-metóda s váhovou maticou rovnajúcou sa inverznej kovariančnej matici náhodných chýb: .

Dá sa ukázať, že vzorec pre GLS odhady parametrov lineárneho modelu má tvar

Kovariančná matica týchto odhadov sa bude rovnať

V skutočnosti podstata OLS spočíva v určitej (lineárnej) transformácii (P) pôvodných údajov a aplikácii obvyklých najmenších štvorcov na transformované údaje. Účelom tejto transformácie je, že pre transformované dáta náhodné chyby už spĺňajú klasické predpoklady.

Vážené najmenšie štvorce

V prípade diagonálnej váhovej matice (a teda kovariančnej matice náhodných chýb) máme takzvané vážené najmenšie štvorce (WLS - Weighted Least Squares). V tomto prípade je vážený súčet štvorcov rezíduí modelu minimalizovaný, to znamená, že každé pozorovanie dostane „váhu“, ktorá je nepriamo úmerná rozptylu náhodnej chyby v tomto pozorovaní: . V skutočnosti sa údaje transformujú vážením pozorovaní (vydelením množstvom úmerným predpokladanej štandardnej odchýlke náhodných chýb) a na vážené údaje sa použijú normálne najmenšie štvorce.

Niektoré špeciálne prípady aplikácie LSM v praxi

Lineárna aproximácia

Zvážte prípad, keď v dôsledku štúdia závislosti určitej skalárnej veličiny od určitej skalárnej veličiny (môže to byť napríklad závislosť napätia od sily prúdu: , kde je konštantná hodnota, odpor vodiča ), boli tieto veličiny namerané, v dôsledku čoho sú hodnoty a im zodpovedajúce hodnoty. Namerané údaje by sa mali zaznamenať do tabuľky.

Tabuľka. Výsledky merania.

| Meranie č. | ||

|---|---|---|

| 1 | ||

| 2 | ||

| 3 | ||

| 4 | ||

| 5 | ||

| 6 |

Otázka znie takto: akú hodnotu koeficientu je možné zvoliť, aby najlepšie popísala závislosť? Podľa najmenších štvorcov by táto hodnota mala byť taká, že súčet štvorcových odchýlok hodnôt od hodnôt

bol minimálny

Súčet štvorcových odchýlok má jeden extrém – minimum, čo nám umožňuje použiť tento vzorec. Z tohto vzorca nájdeme hodnotu koeficientu. Za týmto účelom transformujeme jeho ľavú stranu takto:

Posledný vzorec nám umožňuje nájsť hodnotu koeficientu, ktorý bol v úlohe požadovaný.

Príbeh

Až do začiatku XIX storočia. vedci nemali isté pravidlá na riešenie sústavy rovníc, v ktorej je počet neznámych menší ako počet rovníc; Dovtedy sa používali osobitné metódy v závislosti od typu rovníc a dômyselnosti kalkulačiek, a preto rôzne kalkulačky vychádzajúce z rovnakých pozorovacích údajov dospeli k rôznym záverom. Gaussovi (1795) sa pripisuje prvá aplikácia tejto metódy a Legendre (1805) ju nezávisle objavil a publikoval pod jej moderným názvom (fr. Methode des moindres quarres ). Laplace dal metódu do súvislosti s teóriou pravdepodobnosti a americký matematik Adrain (1808) uvažoval o jej pravdepodobnostných aplikáciách. Metóda je rozšírená a vylepšená ďalším výskumom Enckeho, Bessela, Hansena a ďalších.

Alternatívne využitie nadnárodných spoločností

Myšlienka metódy najmenších štvorcov môže byť použitá aj v iných prípadoch, ktoré priamo nesúvisia s regresnou analýzou. Faktom je, že súčet štvorcov je jednou z najbežnejších mier blízkosti pre vektory (euklidovská metrika v konečných rozmeroch).

Jednou z aplikácií je „riešenie“ systémov lineárnych rovníc, v ktorých je počet rovníc väčší ako počet premenných

kde matica nie je štvorcová, ale obdĺžniková.

Takýto systém rovníc vo všeobecnom prípade nemá riešenie (ak je poradie v skutočnosti väčšie ako počet premenných). Preto je možné tento systém „riešiť“ len v zmysle výberu takého vektora, aby sa minimalizovala „vzdialenosť“ medzi vektormi a . Na tento účel môžete použiť kritérium na minimalizáciu súčtu štvorcových rozdielov ľavej a pravej časti rovníc systému, teda . Je ľahké ukázať, že riešenie tohto minimalizačného problému vedie k riešeniu nasledujúcej sústavy rovníc