Metode kuadrat terkecil dibangun berdasarkan kondisi. Di mana metode kuadrat terkecil diterapkan?

Metode kuadrat terkecil adalah salah satu yang paling umum dan paling berkembang karena kesederhanaan dan efisiensi metode untuk memperkirakan parameter linier. Pada saat yang sama, beberapa kehati-hatian harus diperhatikan saat menggunakannya, karena model yang dibangun dengan menggunakannya mungkin tidak memenuhi sejumlah persyaratan untuk kualitas parameternya dan, sebagai hasilnya, tidak mencerminkan pola pengembangan proses dengan "baik".

Mari kita pertimbangkan prosedur untuk memperkirakan parameter model ekonometrik linier menggunakan metode kuadrat terkecil secara lebih rinci. Model seperti itu dalam bentuk umum dapat diwakili oleh persamaan (1.2):

y t = a 0 + a 1 x 1 t +...+ a n x nt + t .

Data awal saat menaksir parameter a 0 , a 1 ,..., a n adalah vektor dari nilai variabel dependen kamu= (y 1 , y 2 , ... , y T)" dan matriks nilai variabel bebas

di mana kolom pertama, yang terdiri dari satu, sesuai dengan koefisien model .

Metode kuadrat terkecil mendapatkan namanya berdasarkan prinsip dasar bahwa estimasi parameter yang diperoleh atas dasar itu harus memenuhi: jumlah kuadrat dari kesalahan model harus minimal.

Contoh penyelesaian masalah dengan metode kuadrat terkecil

Contoh 2.1. Perusahaan perdagangan memiliki jaringan yang terdiri dari 12 toko, informasi tentang kegiatannya disajikan pada Tabel. 2.1.

Manajemen perusahaan ingin tahu bagaimana ukuran tahunan tergantung pada area penjualan toko.

Tabel 2.1

|

nomor toko |

Omset tahunan, juta rubel |

Area perdagangan, ribu m 2 |

Solusi kuadrat terkecil. Mari kita tentukan - omset tahunan toko -th, juta rubel; - luas penjualan toko ke -th, ribu m 2.

Gambar 2.1. Scatterplot untuk Contoh 2.1

Untuk menentukan bentuk hubungan fungsional antar variabel dan membangun scatterplot (Gbr. 2.1).

Berdasarkan diagram pencar, kita dapat menyimpulkan bahwa omset tahunan secara positif bergantung pada area penjualan (yaitu, y akan meningkat dengan pertumbuhan ). Bentuk koneksi fungsional yang paling tepat adalah linier.

Informasi untuk perhitungan lebih lanjut disajikan pada Tabel. 2.2. Dengan menggunakan metode kuadrat terkecil, kami memperkirakan parameter model ekonometrik satu faktor linier

Tabel 2.2

Dengan demikian,

Oleh karena itu, dengan peningkatan area perdagangan sebesar 1 ribu m 2, hal-hal lain dianggap sama, omset tahunan rata-rata meningkat 67,8871 juta rubel.

Contoh 2.2. Manajemen perusahaan memperhatikan bahwa omset tahunan tidak hanya bergantung pada area penjualan toko (lihat contoh 2.1), tetapi juga pada jumlah rata-rata pengunjung. Informasi yang relevan disajikan dalam tabel. 2.3.

Tabel 2.3

Keputusan. Menunjukkan - jumlah rata-rata pengunjung ke toko per hari, ribuan orang.

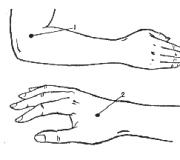

Untuk menentukan bentuk hubungan fungsional antar variabel dan membangun scatterplot (Gbr. 2.2).

Berdasarkan diagram pencar, kita dapat menyimpulkan bahwa omset tahunan berhubungan positif dengan jumlah rata-rata pengunjung per hari (yaitu, y akan meningkat dengan pertumbuhan ). Bentuk ketergantungan fungsional adalah linier.

Beras. 2.2. Scatterplot misalnya 2.2

Tabel 2.4

Secara umum, perlu untuk menentukan parameter model ekonometrik dua faktor

y t \u003d a 0 + a 1 x 1 t + a 2 x 2 t + t

Informasi yang diperlukan untuk perhitungan lebih lanjut disajikan pada Tabel. 2.4.

Mari kita perkirakan parameter model ekonometrika dua faktor linier menggunakan metode kuadrat terkecil.

Dengan demikian,

Evaluasi koefisien = 61,6583 menunjukkan bahwa, semua hal lain dianggap sama, dengan peningkatan area penjualan sebesar 1 ribu m 2, omset tahunan akan meningkat rata-rata 61,6583 juta rubel.

Kami memperkirakan fungsi dengan polinomial derajat ke-2. Untuk melakukan ini, kami menghitung koefisien sistem persamaan normal:

,  ,

,

Mari kita buat sistem normal kuadrat terkecil, yang berbentuk:

Solusi dari sistem mudah ditemukan :, , .

Jadi, polinomial derajat 2 ditemukan: .

Latar belakang teoritis

Kembali ke halaman<Введение в вычислительную математику. Примеры>

Contoh 2. Mencari derajat optimal suatu polinomial.

Kembali ke halaman<Введение в вычислительную математику. Примеры>

Contoh 3. Turunan dari sistem persamaan normal untuk menemukan parameter ketergantungan empiris.

Mari kita turunkan sistem persamaan untuk menentukan koefisien dan fungsi ![]() , yang melakukan pendekatan akar-rata-rata-kuadrat dari fungsi yang diberikan sehubungan dengan titik. Buat fungsi

, yang melakukan pendekatan akar-rata-rata-kuadrat dari fungsi yang diberikan sehubungan dengan titik. Buat fungsi ![]() dan tulis kondisi ekstrem yang diperlukan untuk itu:

dan tulis kondisi ekstrem yang diperlukan untuk itu:

Maka sistem normal akan berbentuk:

Kami telah memperoleh sistem persamaan linier untuk parameter yang tidak diketahui dan, yang mudah diselesaikan.

Latar belakang teoritis

Kembali ke halaman<Введение в вычислительную математику. Примеры>

Contoh.

Data eksperimen tentang nilai-nilai variabel X dan pada diberikan dalam tabel.

Sebagai hasil dari penyelarasannya, fungsi ![]()

Menggunakan metode kuadrat terkecil, perkiraan data ini dengan ketergantungan linier y=ax+b(temukan opsi sebuah dan b). Cari tahu mana dari dua garis yang lebih baik (dalam arti metode kuadrat terkecil) menyelaraskan data eksperimen. Membuat gambar.

Inti dari metode kuadrat terkecil (LSM).

Masalahnya adalah untuk menemukan koefisien ketergantungan linier yang fungsi dari dua variabel sebuah dan b![]() mengambil nilai terkecil. Artinya, mengingat data sebuah dan b jumlah deviasi kuadrat dari data eksperimen dari garis lurus yang ditemukan akan menjadi yang terkecil. Ini adalah inti dari metode kuadrat terkecil.

mengambil nilai terkecil. Artinya, mengingat data sebuah dan b jumlah deviasi kuadrat dari data eksperimen dari garis lurus yang ditemukan akan menjadi yang terkecil. Ini adalah inti dari metode kuadrat terkecil.

Jadi, solusi dari contoh direduksi menjadi menemukan ekstrem dari fungsi dua variabel.

Turunan rumus untuk mencari koefisien.

Sistem dua persamaan dengan dua yang tidak diketahui disusun dan diselesaikan. Menemukan turunan parsial dari fungsi ![]() berdasarkan variabel sebuah dan b, kita menyamakan turunan ini dengan nol.

berdasarkan variabel sebuah dan b, kita menyamakan turunan ini dengan nol.

Kami memecahkan sistem persamaan yang dihasilkan dengan metode apa pun (misalnya metode substitusi atau metode Cramer) dan dapatkan rumus untuk mencari koefisien menggunakan metode kuadrat terkecil (LSM).

Dengan data sebuah dan b fungsi ![]() mengambil nilai terkecil. Bukti dari fakta ini diberikan di bawah dalam teks di akhir halaman.

mengambil nilai terkecil. Bukti dari fakta ini diberikan di bawah dalam teks di akhir halaman.

Itulah seluruh metode kuadrat terkecil. Rumus untuk mencari parameter sebuah berisi jumlah , , , dan parameter n adalah jumlah data percobaan. Nilai dari jumlah ini direkomendasikan untuk dihitung secara terpisah.

Koefisien b ditemukan setelah perhitungan sebuah.

Saatnya untuk mengingat contoh aslinya.

Keputusan.

Dalam contoh kita n=5. Kami mengisi tabel untuk kenyamanan menghitung jumlah yang termasuk dalam rumus koefisien yang diperlukan.

Nilai pada baris keempat tabel diperoleh dengan mengalikan nilai baris ke-2 dengan nilai baris ke-3 untuk setiap angka saya.

Nilai pada baris kelima tabel diperoleh dengan mengkuadratkan nilai baris ke-2 untuk setiap angka saya.

Nilai kolom terakhir dari tabel adalah jumlah nilai di seluruh baris.

Kami menggunakan rumus metode kuadrat terkecil untuk menemukan koefisien sebuah dan b. Kami menggantinya dengan nilai yang sesuai dari kolom terakhir tabel:

Karena itu, y=0.165x+2.184 adalah garis lurus aproksimasi yang diinginkan.

Masih mencari tahu yang mana dari garis y=0.165x+2.184 atau ![]() lebih baik mendekati data asli, yaitu membuat perkiraan menggunakan metode kuadrat terkecil.

lebih baik mendekati data asli, yaitu membuat perkiraan menggunakan metode kuadrat terkecil.

Estimasi kesalahan metode kuadrat terkecil.

Untuk melakukan ini, Anda perlu menghitung jumlah deviasi kuadrat dari data asli dari garis-garis ini ![]() dan

dan ![]() , nilai yang lebih kecil sesuai dengan garis yang lebih mendekati data asli dalam hal metode kuadrat terkecil.

, nilai yang lebih kecil sesuai dengan garis yang lebih mendekati data asli dalam hal metode kuadrat terkecil.

Karena , maka garis y=0.165x+2.184 mendekati data asli dengan lebih baik.

Ilustrasi grafis dari metode kuadrat terkecil (LSM).

Semuanya tampak hebat di tangga lagu. Garis merah adalah garis yang ditemukan y=0.165x+2.184, garis biru adalah ![]() , titik-titik merah muda adalah data asli.

, titik-titik merah muda adalah data asli.

Untuk apa, untuk apa semua perkiraan ini?

Saya pribadi menggunakan untuk memecahkan masalah pemulusan data, masalah interpolasi dan ekstrapolasi (dalam contoh asli, Anda dapat diminta untuk menemukan nilai dari nilai yang diamati kamu pada x=3 atau kapan x=6 menurut metode MNC). Tetapi kita akan membicarakan lebih lanjut tentang ini nanti di bagian lain situs ini.

Bagian atas halaman

Bukti.

Sehingga ketika ditemukan sebuah dan b fungsi mengambil nilai terkecil, perlu bahwa pada titik ini matriks bentuk kuadrat dari diferensial orde kedua untuk fungsi ![]() pasti positif. Mari kita tunjukkan.

pasti positif. Mari kita tunjukkan.

Diferensial orde kedua memiliki bentuk:

Yaitu

Oleh karena itu, matriks bentuk kuadrat memiliki bentuk

dan nilai elemen tidak bergantung pada sebuah dan b.

Mari kita tunjukkan bahwa matriks tersebut pasti positif. Ini mensyaratkan bahwa sudut minor harus positif.

Minor sudut dari orde pertama  . Ketimpangannya sangat ketat, karena titik-titiknya tidak bertepatan. Ini akan tersirat dalam apa yang berikut.

. Ketimpangannya sangat ketat, karena titik-titiknya tidak bertepatan. Ini akan tersirat dalam apa yang berikut.

Minor sudut dari orde kedua

Ayo buktikan  metode induksi matematika.

metode induksi matematika.

Kesimpulan: nilai yang ditemukan sebuah dan b sesuai dengan nilai terkecil dari fungsi ![]() , oleh karena itu, adalah parameter yang diinginkan untuk metode kuadrat terkecil.

, oleh karena itu, adalah parameter yang diinginkan untuk metode kuadrat terkecil.

Pernah mengerti?

Memesan Solusi

Bagian atas halaman

Pengembangan ramalan menggunakan metode kuadrat terkecil. Contoh solusi masalah

Ekstrapolasi - ini adalah metode penelitian ilmiah, yang didasarkan pada penyebaran tren masa lalu dan sekarang, pola, hubungan dengan perkembangan masa depan objek peramalan. Metode ekstrapolasi meliputi: metode rata-rata bergerak, metode pemulusan eksponensial, metode kuadrat terkecil.

Esensi metode kuadrat terkecil terdiri dari meminimalkan jumlah deviasi kuadrat antara nilai yang diamati dan yang dihitung. Nilai yang dihitung ditemukan sesuai dengan persamaan yang dipilih - persamaan regresi. Semakin kecil jarak antara nilai sebenarnya dan yang dihitung, semakin akurat perkiraan berdasarkan persamaan regresi.

Analisis teoretis tentang esensi fenomena yang diteliti, perubahan yang ditampilkan oleh deret waktu, berfungsi sebagai dasar untuk memilih kurva. Pertimbangan tentang sifat pertumbuhan tingkat seri kadang-kadang diperhitungkan. Jadi, jika pertumbuhan output diharapkan dalam deret aritmatika, maka pemulusan dilakukan dalam garis lurus. Jika ternyata pertumbuhannya eksponensial, maka pemulusan harus dilakukan sesuai dengan fungsi eksponensial.

Rumus kerja metode kuadrat terkecil : Y t+1 = a*X + b, di mana t + 1 adalah periode perkiraan; t+1 – indikator yang diprediksi; a dan b adalah koefisien; X adalah simbol waktu.

Koefisien a dan b dihitung menurut rumus berikut:

|

|

di mana, Uf - nilai aktual dari rangkaian dinamika; n adalah jumlah level dalam deret waktu;

Pemulusan deret waktu dengan metode kuadrat terkecil berfungsi untuk mencerminkan pola perkembangan fenomena yang diteliti. Dalam ekspresi analitik dari sebuah tren, waktu dianggap sebagai variabel independen, dan tingkat deret bertindak sebagai fungsi dari variabel independen ini.

Perkembangan suatu fenomena tidak tergantung pada berapa tahun telah berlalu sejak titik awalnya, tetapi pada faktor-faktor apa yang mempengaruhi perkembangannya, ke arah mana dan dengan intensitas apa. Dari sini jelas bahwa perkembangan suatu fenomena dalam waktu muncul sebagai akibat dari tindakan faktor-faktor ini.

Mengatur jenis kurva dengan benar, jenis ketergantungan analitis pada waktu adalah salah satu tugas analisis pra-prediktif yang paling sulit. .

Pilihan jenis fungsi yang menggambarkan tren, parameter yang ditentukan oleh metode kuadrat terkecil, dalam banyak kasus empiris, dengan membangun sejumlah fungsi dan membandingkannya satu sama lain sesuai dengan nilai akar- kesalahan rata-rata kuadrat, dihitung dengan rumus:

|

di mana Uf - nilai aktual dari rangkaian dinamika; Ur – nilai yang dihitung (dihaluskan) dari deret waktu; n adalah jumlah level dalam deret waktu; p adalah jumlah parameter yang ditentukan dalam rumus yang menggambarkan tren (tren perkembangan).

Kekurangan dari metode kuadrat terkecil :

- ketika mencoba menggambarkan fenomena ekonomi yang diteliti menggunakan persamaan matematis, ramalan akan akurat untuk waktu yang singkat dan persamaan regresi harus dihitung ulang saat informasi baru tersedia;

- kompleksitas pemilihan persamaan regresi, yang dapat dipecahkan dengan menggunakan program komputer standar.

Contoh penggunaan metode kuadrat terkecil untuk mengembangkan ramalan

Tugas . Terdapat data yang mencirikan tingkat pengangguran di wilayah tersebut, %

- Buat perkiraan tingkat pengangguran di wilayah tersebut untuk bulan November, Desember, Januari, dengan menggunakan metode: rata-rata bergerak, pemulusan eksponensial, kuadrat terkecil.

- Hitung kesalahan dalam peramalan yang dihasilkan menggunakan masing-masing metode.

- Bandingkan hasil yang diperoleh, tarik kesimpulan.

solusi kuadrat terkecil

Untuk solusinya, kami akan menyusun tabel di mana kami akan membuat perhitungan yang diperlukan:

= 28,63/10 = 2,86% akurasi perkiraan tinggi.

Kesimpulan : Membandingkan hasil yang diperoleh dalam perhitungan metode rata-rata bergerak , pemulusan eksponensial dan metode kuadrat terkecil, kita dapat mengatakan bahwa kesalahan relatif rata-rata dalam perhitungan dengan metode pemulusan eksponensial berada dalam kisaran 20-50%. Ini berarti bahwa akurasi prediksi dalam hal ini hanya memuaskan.

Dalam kasus pertama dan ketiga, akurasi ramalan tinggi, karena kesalahan relatif rata-rata kurang dari 10%. Tetapi metode rata-rata bergerak memungkinkan untuk mendapatkan hasil yang lebih andal (perkiraan untuk November - 1,52%, perkiraan untuk Desember - 1,53%, perkiraan untuk Januari - 1,49%), karena kesalahan relatif rata-rata saat menggunakan metode ini adalah yang terkecil - 1 ,tigabelas%.

Metode kuadrat terkecil

Artikel terkait lainnya:

Daftar sumber yang digunakan

- Rekomendasi ilmiah dan metodologis tentang masalah mendiagnosis risiko sosial dan memperkirakan tantangan, ancaman, dan konsekuensi sosial. Universitas Sosial Negeri Rusia. Moskow. 2010;

- Vladimirova L.P. Peramalan dan perencanaan dalam kondisi pasar: Proc. uang saku. M.: Rumah Penerbitan "Dashkov and Co", 2001;

- Novikova N.V., Pozdeeva O.G. Prakiraan Perekonomian Nasional: Panduan Pendidikan dan Metodologi. Yekaterinburg: Rumah Penerbitan Ural. negara ekonomi universitas, 2007;

- Slutskin L.N. Kursus MBA dalam peramalan bisnis. Moskow: Buku Bisnis Alpina, 2006.

Program MNE

Masukkan data

Data dan Perkiraan y = a + bx

saya- nomor titik percobaan;

x saya- nilai parameter tetap pada titik saya;

aku- nilai parameter yang diukur pada titik saya;

saya- pengukuran berat pada titik saya;

y saya, kal.- perbedaan antara nilai yang diukur dan nilai yang dihitung dari regresi kamu pada intinya saya;

S x i (x i)- perkiraan kesalahan x saya saat mengukur kamu pada intinya saya.

Data dan Perkiraan y = k x

| saya | x saya | aku | saya | y saya, kal. | y saya | S x i (x i) |

|---|

Klik pada grafik

Panduan pengguna untuk program online MNC.

Di bidang data, masukkan nilai `x` dan `y` pada setiap baris terpisah pada satu titik percobaan. Nilai harus dipisahkan dengan spasi (spasi atau tab).

Nilai ketiga dapat berupa bobot titik dari `w`. Jika bobot poin tidak ditentukan, maka itu sama dengan satu. Dalam sebagian besar kasus, bobot titik eksperimen tidak diketahui atau tidak dihitung; semua data eksperimen dianggap setara. Terkadang bobot dalam rentang nilai yang dipelajari pasti tidak setara dan bahkan dapat dihitung secara teoritis. Misalnya, dalam spektrofotometri, bobot dapat dihitung menggunakan rumus sederhana, meskipun pada dasarnya semua orang mengabaikan hal ini untuk mengurangi biaya tenaga kerja.

Data dapat ditempelkan melalui clipboard dari spreadsheet office suite, seperti Excel dari Microsoft Office atau Calc dari Open Office. Untuk melakukannya, di spreadsheet, pilih rentang data yang akan disalin, salin ke papan klip, dan tempel data ke bidang data di halaman ini.

Untuk menghitung dengan metode kuadrat terkecil, setidaknya diperlukan dua titik untuk menentukan dua koefisien `b` - garis singgung sudut kemiringan garis lurus dan `a` - nilai yang dipotong oleh garis lurus pada `y ` sumbu.

Untuk memperkirakan kesalahan dari koefisien regresi yang dihitung, perlu untuk mengatur jumlah titik eksperimen menjadi lebih dari dua.

Metode kuadrat terkecil (LSM).

Semakin besar jumlah titik eksperimen, semakin akurat estimasi statistik koefisien (karena penurunan koefisien Student) dan semakin dekat estimasi dengan estimasi sampel umum.

Memperoleh nilai pada setiap titik eksperimental sering dikaitkan dengan biaya tenaga kerja yang signifikan, oleh karena itu, sejumlah eksperimen sering dilakukan, yang memberikan perkiraan yang dapat dicerna dan tidak menyebabkan biaya tenaga kerja yang berlebihan. Sebagai aturan, jumlah titik eksperimental untuk ketergantungan kuadrat terkecil linier dengan dua koefisien dipilih di wilayah 5-7 poin.

Teori Singkat Kuadrat Terkecil untuk Ketergantungan Linier

Misalkan kita memiliki sekumpulan data eksperimen berupa pasangan nilai [`y_i`, `x_i`], di mana `i` adalah jumlah satu pengukuran eksperimental dari 1 hingga `n`; `y_i` - nilai nilai terukur pada titik `i`; `x_i` - nilai parameter yang kita tetapkan pada titik `i`.

Contohnya adalah operasi hukum Ohm. Dengan mengubah tegangan (beda potensial) antara bagian dari rangkaian listrik, kami mengukur jumlah arus yang melewati bagian ini. Fisika memberi kita ketergantungan yang ditemukan secara eksperimental:

`I = U/R`,

di mana `I` - kekuatan saat ini; `R` - resistensi; `U` - tegangan.

Dalam hal ini, `y_i` adalah nilai arus terukur, dan `x_i` adalah nilai tegangan.

Sebagai contoh lain, perhatikan penyerapan cahaya oleh larutan suatu zat dalam larutan. Kimia memberi kita rumus:

`A = l C`,

di mana `A` adalah kerapatan optik solusi; `ε` - transmisi zat terlarut; `l` - panjang lintasan ketika cahaya melewati kuvet dengan larutan; `C` adalah konsentrasi zat terlarut.

Dalam hal ini, `y_i` adalah kerapatan optik terukur `A`, dan `x_i` adalah konsentrasi zat yang kita tetapkan.

Kami akan mempertimbangkan kasus ketika kesalahan relatif dalam menyetel `x_i` jauh lebih kecil daripada kesalahan relatif dalam mengukur `y_i`. Kami juga akan mengasumsikan bahwa semua nilai terukur `y_i` adalah acak dan terdistribusi normal, mis. mematuhi hukum distribusi normal.

Dalam kasus ketergantungan linier `y` pada `x`, kita dapat menulis ketergantungan teoretis:

`y = a + bx`.

Dari sudut pandang geometris, koefisien `b` menunjukkan garis singgung sudut kemiringan garis terhadap sumbu `x`, dan koefisien `a` - nilai `y` pada titik perpotongan garis garis dengan sumbu `y` (untuk `x = 0`).

Menemukan parameter garis regresi.

Dalam sebuah eksperimen, nilai terukur `y_i` tidak dapat terletak tepat pada garis teoretis karena kesalahan pengukuran, yang selalu melekat dalam kehidupan nyata. Oleh karena itu, persamaan linier harus diwakili oleh sistem persamaan:

`y_i = a + b x_i + _i` (1),

di mana `ε_i` adalah kesalahan pengukuran `y` yang tidak diketahui dalam eksperimen `i`.

Ketergantungan (1) juga disebut regresi, yaitu ketergantungan dua kuantitas satu sama lain dengan signifikansi statistik.

Tugas memulihkan ketergantungan adalah menemukan koefisien `a` dan `b` dari titik eksperimental [`y_i`, `x_i`].

Untuk mencari koefisien `a` dan `b` biasanya digunakan metode kuadrat terkecil(MNK). Ini adalah kasus khusus dari prinsip kemungkinan maksimum.

Mari kita tulis ulang (1) sebagai `ε_i = y_i - a - b x_i`.

Maka jumlah kesalahan kuadrat adalah

`Φ = jumlah_(i=1)^(n) _i^2 = jumlah_(i=1)^(n) (y_i - a - b x_i)^2`. (2)

Prinsip dari metode kuadrat terkecil adalah meminimalkan jumlah (2) terhadap parameter `a` dan `b`.

Minimum tercapai ketika turunan parsial dari jumlah (2) sehubungan dengan koefisien `a` dan `b` sama dengan nol:

`frac(sebagian )(sebagian a) = frac(jumlah sebagian_(i=1)^(n) (y_i - a - b x_i)^2)(sebagian a) = 0`

`frac(sebagian )(sebagian b) = frac(jumlah sebagian_(i=1)^(n) (y_i - a - b x_i)^2)(sebagian b) = 0`

Memperluas turunan, kami memperoleh sistem dua persamaan dengan dua yang tidak diketahui:

`jumlah_(i=1)^(n) (2a + 2bx_i - 2y_i) = jumlah_(i=1)^(n) (a + bx_i - y_i) = 0`

`sum_(i=1)^(n) (2bx_i^2 + 2ax_i - 2x_iy_i) = sum_(i=1)^(n) (bx_i^2 + ax_i - x_iy_i) = 0`

Kami membuka tanda kurung dan mentransfer jumlah yang tidak tergantung pada koefisien yang diinginkan ke setengah lainnya, kami mendapatkan sistem persamaan linier:

`jumlah_(i=1)^(n) y_i = a n + b jumlah_(i=1)^(n) bx_i`

`jumlah_(i=1)^(n) x_iy_i = jumlah_(i=1)^(n) x_i + b jumlah_(i=1)^(n) x_i^2`

Memecahkan sistem yang dihasilkan, kami menemukan rumus untuk koefisien `a` dan `b`:

`a = frac(sum_(i=1)^(n) y_i sum_(i=1)^(n) x_i^2 - sum_(i=1)^(n) x_i sum_(i=1)^(n ) x_iy_i) (n sum_(i=1)^(n) x_i^2 — (sum_(i=1)^(n) x_i)^2)` (3.1)

`b = frac(n jumlah_(i=1)^(n) x_iy_i - jumlah_(i=1)^(n) x_i jumlah_(i=1)^(n) y_i) (n jumlah_(i=1)^ (n) x_i^2 - (jumlah_(i=1)^(n) x_i)^2)` (3.2)

Rumus ini memiliki solusi ketika `n > 1` (garis dapat ditarik menggunakan setidaknya 2 titik) dan ketika determinan `D = n sum_(i=1)^(n) x_i^2 — (sum_(i= 1 )^(n) x_i)^2 != 0`, mis. ketika titik `x_i` dalam eksperimen berbeda (yaitu ketika garis tidak vertikal).

Estimasi kesalahan dalam koefisien garis regresi

Untuk perkiraan kesalahan yang lebih akurat dalam menghitung koefisien `a` dan `b`, sejumlah besar titik eksperimen diinginkan. Ketika `n = 2`, tidak mungkin untuk memperkirakan kesalahan koefisien, karena garis aproksimasi akan secara unik melewati dua titik.

Kesalahan dari variabel acak `V` ditentukan hukum akumulasi kesalahan

`S_V^2 = jumlah_(i=1)^p (frac(sebagian f)(sebagian z_i))^2 S_(z_i)^2`,

di mana `p` adalah jumlah parameter `z_i` dengan kesalahan `S_(z_i)` yang memengaruhi kesalahan `S_V`;

`f` adalah fungsi ketergantungan `V` pada `z_i`.

Mari kita tulis hukum akumulasi kesalahan untuk kesalahan koefisien `a` dan `b`

`S_a^2 = jumlah_(i=1)^(n)(frac(sebagian a)(sebagian y_i))^2 S_(y_i)^2 + jumlah_(i=1)^(n)(frac(sebagian a )(sebagian x_i))^2 S_(x_i)^2 = S_y^2 jumlah_(i=1)^(n)(frac(sebagian a)(sebagian y_i))^2 `,

`S_b^2 = jumlah_(i=1)^(n)(frac(sebagian b)(sebagian y_i))^2 S_(y_i)^2 + jumlah_(i=1)^(n)(frac(sebagian b )(sebagian x_i))^2 S_(x_i)^2 = S_y^2 jumlah_(i=1)^(n)(frac(sebagian b)(sebagian y_i))^2 `,

karena `S_(x_i)^2 = 0` (sebelumnya kami membuat reservasi bahwa kesalahan `x` dapat diabaikan).

`S_y^2 = S_(y_i)^2` - kesalahan (varians, deviasi standar kuadrat) dalam dimensi `y`, dengan asumsi bahwa kesalahan seragam untuk semua nilai `y`.

Mengganti rumus untuk menghitung `a` dan `b` ke dalam ekspresi yang dihasilkan, kita mendapatkan

`S_a^2 = S_y^2 frac(sum_(i=1)^(n) (sum_(i=1)^(n) x_i^2 - x_i sum_(i=1)^(n) x_i)^2 ) (D^2) = S_y^2 frac((n sum_(i=1)^(n) x_i^2 - (sum_(i=1)^(n) x_i)^2) sum_(i=1) ^(n) x_i^2) (D^2) = S_y^2 frac(sum_(i=1)^(n) x_i^2) (D)` (4.1)

`S_b^2 = S_y^2 frac(sum_(i=1)^(n) (n x_i - sum_(i=1)^(n) x_i)^2) (D^2) = S_y^2 frac( n (n jumlah_(i=1)^(n) x_i^2 - (jumlah_(i=1)^(n) x_i)^2)) (D^2) = S_y^2 frac(n) (D) ` (4.2)

Dalam kebanyakan eksperimen nyata, nilai `Sy` tidak diukur. Untuk melakukan ini, perlu untuk melakukan beberapa pengukuran paralel (eksperimen) pada satu atau beberapa titik rencana, yang meningkatkan waktu (dan mungkin biaya) eksperimen. Oleh karena itu, biasanya diasumsikan bahwa penyimpangan `y` dari garis regresi dapat dianggap acak. Estimasi varians `y` dalam hal ini dihitung dengan rumus.

`S_y^2 = S_(y, istirahat)^2 = frac(sum_(i=1)^n (y_i - a - b x_i)^2) (n-2)`.

Pembagi `n-2` muncul karena kita telah mengurangi jumlah derajat kebebasan karena perhitungan dua koefisien untuk sampel data eksperimen yang sama.

Estimasi ini juga disebut varians residual relatif terhadap garis regresi `S_(y, rest)^2`.

Penilaian signifikansi koefisien dilakukan sesuai dengan kriteria Siswa

`t_a = frac(|a|) (S_a)`, `t_b = frac(|b|) (S_b)`

Jika kriteria yang dihitung `t_a`, `t_b` lebih kecil dari kriteria tabel `t(P, n-2)`, maka dianggap bahwa koefisien yang sesuai tidak berbeda nyata dari nol dengan probabilitas `P` yang diberikan.

Untuk menilai kualitas deskripsi hubungan linier, Anda dapat membandingkan `S_(y, rest)^2` dan `S_(bar y)` relatif terhadap mean menggunakan kriteria Fisher.

`S_(bar y) = frac(sum_(i=1)^n (y_i - bar y)^2) (n-1) = frac(sum_(i=1)^n (y_i - (sum_(i= 1)^n y_i) /n)^2) (n-1)` - estimasi sampel varians `y` relatif terhadap mean.

Untuk mengevaluasi efektivitas persamaan regresi untuk menggambarkan ketergantungan, koefisien Fisher dihitung

`F = S_(bar y) / S_(y, istirahat)^2`,

yang dibandingkan dengan koefisien Fisher tabular `F(p, n-1, n-2)`.

Jika `F > F(P, n-1, n-2)`, perbedaan antara deskripsi ketergantungan `y = f(x)` menggunakan persamaan regresi dan deskripsi menggunakan mean dianggap signifikan secara statistik dengan probabilitas `P`. Itu. regresi menggambarkan ketergantungan lebih baik daripada penyebaran `y` di sekitar rata-rata.

Klik pada grafik

untuk menambahkan nilai ke tabel

Metode kuadrat terkecil. Metode kuadrat terkecil berarti penentuan parameter yang tidak diketahui a, b, c, ketergantungan fungsional yang diterima

Metode kuadrat terkecil berarti penentuan parameter yang tidak diketahui a, b, c,… ketergantungan fungsional yang diterima

y = f(x,a,b,c,…),

yang akan memberikan minimum kuadrat rata-rata (varians) dari kesalahan

, (24)

, (24)

dimana x i , y i - himpunan pasangan bilangan yang diperoleh dari percobaan.

Karena syarat ekstrem suatu fungsi beberapa variabel adalah syarat turunan parsialnya sama dengan nol, maka parameternya a, b, c,… ditentukan dari sistem persamaan:

; ; ; … (25)

Harus diingat bahwa metode kuadrat terkecil digunakan untuk memilih parameter setelah bentuk fungsi y = f(x) didefinisikan.

Jika dari pertimbangan teoretis tidak mungkin untuk menarik kesimpulan apa pun tentang rumus empiris yang seharusnya, maka seseorang harus dipandu oleh representasi visual, terutama representasi grafis dari data yang diamati.

Dalam praktiknya, paling sering terbatas pada jenis fungsi berikut:

1) linier ![]() ;

;

2) kuadrat a.

Memilih jenis fungsi regresi, mis. jenis model ketergantungan Y pada X (atau X pada Y) yang dipertimbangkan, misalnya, model linier y x \u003d a + bx, perlu untuk menentukan nilai spesifik dari koefisien model.

Untuk nilai a dan b yang berbeda, dimungkinkan untuk membuat jumlah tak hingga dari ketergantungan dalam bentuk y x =a+bx, yaitu, ada jumlah garis yang tak terbatas pada bidang koordinat, tetapi kita membutuhkan ketergantungan sedemikian rupa sehingga sesuai dengan nilai yang diamati dengan cara terbaik. Dengan demikian, masalahnya direduksi menjadi pemilihan koefisien terbaik.

Kami mencari fungsi linier a + bx, hanya berdasarkan pada sejumlah pengamatan yang tersedia. Untuk menemukan fungsi yang paling cocok dengan nilai yang diamati, kami menggunakan metode kuadrat terkecil.

Keterangan: Y i - nilai yang dihitung dengan persamaan Y i =a+bx i . y i - nilai terukur, i =y i -Y i - perbedaan antara nilai terukur dan terhitung, i =y i -a-bx i .

Metode kuadrat terkecil mensyaratkan bahwa i , perbedaan antara y i yang diukur dan nilai Y i yang dihitung dari persamaan, menjadi minimal. Oleh karena itu, kami menemukan koefisien a dan b sehingga jumlah deviasi kuadrat dari nilai-nilai yang diamati dari nilai-nilai pada garis regresi lurus adalah yang terkecil:

Menyelidiki fungsi argumen a dan dengan bantuan turunan ke ekstrem, kita dapat membuktikan bahwa fungsi tersebut mengambil nilai minimum jika koefisien a dan b adalah solusi dari sistem:

(2)

(2)

Jika kita membagi kedua ruas persamaan normal dengan n, kita peroleh:

Mengingat bahwa  (3)

(3)

Mendapatkan  , dari sini, dengan mensubstitusi nilai a dalam persamaan pertama, kita mendapatkan:

, dari sini, dengan mensubstitusi nilai a dalam persamaan pertama, kita mendapatkan:

Dalam hal ini, b disebut koefisien regresi; a disebut anggota bebas dari persamaan regresi dan dihitung dengan rumus:

Garis lurus yang dihasilkan merupakan perkiraan untuk garis regresi teoritis. Kita punya:

Jadi, ![]() adalah persamaan regresi linier.

adalah persamaan regresi linier.

Regresi dapat langsung (b>0) dan invers (b Contoh 1. Hasil pengukuran nilai X dan Y diberikan dalam tabel:

| x saya | -2 | 0 | 1 | 2 | 4 |

| aku | 0.5 | 1 | 1.5 | 2 | 3 |

Dengan asumsi ada hubungan linier antara X dan Y y=a+bx, tentukan koefisien a dan b dengan menggunakan metode kuadrat terkecil.

Keputusan. Di sini n=5

x i =-2+0+1+2+4=5;

x i 2 =4+0+1+4+16=25

x i y i =-2 0.5+0 1+1 1.5+2 2+4 3=16.5

y i =0,5+1+1,5+2+3=8

dan sistem normal (2) memiliki bentuk ![]()

Memecahkan sistem ini, kita mendapatkan: b=0,425, a=1,175. Jadi y=1,175+0,425x.

Contoh 2. Terdapat 10 sampel pengamatan indikator ekonomi (X) dan (Y).

| x saya | 180 | 172 | 173 | 169 | 175 | 170 | 179 | 170 | 167 | 174 |

| aku | 186 | 180 | 176 | 171 | 182 | 166 | 182 | 172 | 169 | 177 |

Diperlukan untuk menemukan persamaan regresi sampel Y pada X. Buatlah garis regresi sampel Y pada X.

Keputusan. 1. Mari kita urutkan data berdasarkan nilai x i dan y i . Kami mendapatkan tabel baru:

| x saya | 167 | 169 | 170 | 170 | 172 | 173 | 174 | 175 | 179 | 180 |

| aku | 169 | 171 | 166 | 172 | 180 | 176 | 177 | 182 | 182 | 186 |

Untuk menyederhanakan perhitungan, kami akan menyusun tabel perhitungan di mana kami akan memasukkan nilai numerik yang diperlukan.

| x saya | aku | x saya 2 | x saya y saya |

| 167 | 169 | 27889 | 28223 |

| 169 | 171 | 28561 | 28899 |

| 170 | 166 | 28900 | 28220 |

| 170 | 172 | 28900 | 29240 |

| 172 | 180 | 29584 | 30960 |

| 173 | 176 | 29929 | 30448 |

| 174 | 177 | 30276 | 30798 |

| 175 | 182 | 30625 | 31850 |

| 179 | 182 | 32041 | 32578 |

| 180 | 186 | 32400 | 33480 |

| x i = 1729 | y i =1761 | x saya 2 299105 | x i y i =304696 |

| x=172,9 | y=176,1 | x i 2 =29910.5 | xy=30469.6 |

Menurut rumus (4), kami menghitung koefisien regresi

dan dengan rumus (5)

Dengan demikian, persamaan regresi sampel terlihat seperti y=-59,34+1,3804x.

Mari kita plot titik-titik (x i ; y i) pada bidang koordinat dan tandai garis regresi.

Gambar 4

Gambar 4 menunjukkan bagaimana nilai yang diamati terletak relatif terhadap garis regresi. Untuk memperkirakan secara numerik penyimpangan y i dari Y i , di mana y i adalah nilai yang diamati, dan Y i adalah nilai yang ditentukan oleh regresi, kami akan membuat tabel:

| x saya | aku | aku | Y saya -y saya |

| 167 | 169 | 168.055 | -0.945 |

| 169 | 171 | 170.778 | -0.222 |

| 170 | 166 | 172.140 | 6.140 |

| 170 | 172 | 172.140 | 0.140 |

| 172 | 180 | 174.863 | -5.137 |

| 173 | 176 | 176.225 | 0.225 |

| 174 | 177 | 177.587 | 0.587 |

| 175 | 182 | 178.949 | -3.051 |

| 179 | 182 | 184.395 | 2.395 |

| 180 | 186 | 185.757 | -0.243 |

Nilai Y i dihitung sesuai dengan persamaan regresi.

Penyimpangan yang nyata dari beberapa nilai yang diamati dari garis regresi dijelaskan oleh sedikitnya jumlah pengamatan. Saat mempelajari tingkat ketergantungan linier Y pada X, jumlah pengamatan diperhitungkan. Kekuatan ketergantungan ditentukan oleh nilai koefisien korelasi.

Metode kuadrat terkecil digunakan untuk mengestimasi parameter persamaan regresi.Salah satu metode untuk mempelajari hubungan stokastik antar fitur adalah analisis regresi.

Analisis regresi adalah turunan dari persamaan regresi, yang digunakan untuk mencari nilai rata-rata dari suatu variabel acak (fitur-hasil), jika nilai variabel lain (atau lainnya) (faktor-fitur) diketahui. Ini mencakup langkah-langkah berikut:

- pilihan bentuk hubungan (jenis persamaan regresi analitik);

- estimasi parameter persamaan;

- evaluasi kualitas persamaan regresi analitik.

Dalam kasus hubungan pasangan linier, persamaan regresi akan berbentuk: y i =a+b·x i +u i . Parameter persamaan a dan b ini diestimasi dari data pengamatan statistik x dan y . Hasil dari penilaian tersebut adalah persamaan: , dimana , - estimasi parameter a dan b , - nilai fitur efektif (variabel) yang diperoleh dengan persamaan regresi (calculated value).

Yang paling umum digunakan untuk estimasi parameter adalah metode kuadrat terkecil (LSM).

Metode kuadrat terkecil memberikan estimasi parameter persamaan regresi yang terbaik (konsisten, efisien dan tidak bias). Tetapi hanya jika asumsi tertentu tentang suku acak (u) dan variabel bebas (x) terpenuhi (lihat asumsi OLS).

Masalah menaksir parameter persamaan pasangan linier dengan metode kuadrat terkecil terdiri dari yang berikut: untuk mendapatkan estimasi parameter , , di mana jumlah deviasi kuadrat dari nilai aktual fitur efektif - y i dari nilai yang dihitung - minimal.

Secara formal kriteria OLS dapat ditulis seperti ini:  .

.

Klasifikasi metode kuadrat terkecil

- Metode kuadrat terkecil.

- Metode kemungkinan maksimum (untuk model regresi linier klasik normal, normalitas residu regresi didalilkan).

- Metode kuadrat terkecil umum GLSM digunakan dalam kasus autokorelasi kesalahan dan dalam kasus heteroskedastisitas.

- Metode kuadrat terkecil tertimbang (kasus khusus GLSM dengan residu heteroskedastis).

Ilustrasikan esensinya metode klasik kuadrat terkecil secara grafis. Untuk melakukan ini, kita akan membangun plot titik menurut data pengamatan (x i , y i , i=1;n) dalam sistem koordinat persegi panjang (plot titik seperti itu disebut bidang korelasi). Mari kita coba mencari garis lurus yang paling dekat dengan titik-titik bidang korelasi. Menurut metode kuadrat terkecil, garis dipilih sehingga jumlah kuadrat jarak vertikal antara titik-titik bidang korelasi dan garis ini menjadi minimal.

Notasi matematika dari masalah ini:  .

.

Nilai y i dan x i =1...n kita ketahui, ini adalah data observasional. Dalam fungsi S mereka adalah konstanta. Variabel dalam fungsi ini adalah perkiraan yang diperlukan dari parameter - , . Untuk menemukan fungsi minimum dari 2 variabel, perlu untuk menghitung turunan parsial dari fungsi ini terhadap masing-masing parameter dan menyamakannya dengan nol, yaitu.  .

.

Akibatnya, kami memperoleh sistem 2 persamaan linier normal:

Memecahkan sistem ini, kami menemukan perkiraan parameter yang diperlukan:

Kebenaran perhitungan parameter persamaan regresi dapat diperiksa dengan membandingkan jumlah (beberapa perbedaan mungkin terjadi karena pembulatan perhitungan).

Untuk menghitung estimasi parameter, Anda dapat membuat Tabel 1.

Tanda koefisien regresi b menunjukkan arah hubungan (jika b > 0, hubungan searah, jika b<0, то связь обратная). Величина b показывает на сколько единиц изменится в среднем признак-результат -y при изменении признака-фактора - х на 1 единицу своего измерения.

Secara formal, nilai parameter a adalah nilai rata-rata y untuk x sama dengan nol. Jika faktor tanda tidak memiliki dan tidak dapat memiliki nilai nol, maka interpretasi parameter a di atas tidak masuk akal.

Penilaian ketatnya hubungan antar fitur

dilakukan dengan menggunakan koefisien korelasi pasangan linier - r x,y . Itu dapat dihitung menggunakan rumus:  . Selain itu, koefisien korelasi pasangan linier dapat ditentukan dengan koefisien regresi b:

. Selain itu, koefisien korelasi pasangan linier dapat ditentukan dengan koefisien regresi b:  .

.

Kisaran nilai koefisien linier korelasi pasangan yang dapat diterima adalah dari -1 hingga +1. Tanda koefisien korelasi menunjukkan arah hubungan. Jika r x, y >0, maka sambungannya searah; jika r x, y<0, то связь обратная.

Jika koefisien ini mendekati satu dalam modulus, maka hubungan antar fitur dapat diinterpretasikan sebagai hubungan linier yang cukup dekat. Jika modulusnya sama dengan satu r x , y =1, maka hubungan antar fitur bersifat linier fungsional. Jika fitur x dan y bebas linier, maka r x,y mendekati 0.

Tabel 1 juga dapat digunakan untuk menghitung r x,y.

Untuk menilai kualitas persamaan regresi yang diperoleh, koefisien determinasi teoritis dihitung - R 2 yx:  ,

,

di mana d 2 adalah varians y yang dijelaskan oleh persamaan regresi;

e 2 - residual (tidak dijelaskan oleh persamaan regresi) varians y ;

s 2 y - total (total) varians y .

Koefisien determinasi mencirikan proporsi variasi (dispersi) dari fitur yang dihasilkan y, dijelaskan oleh regresi (dan, akibatnya, faktor x), dalam variasi total (dispersi) y. Koefisien determinasi R 2 yx mengambil nilai dari 0 hingga 1. Dengan demikian, nilai 1-R 2 yx mencirikan proporsi varians y yang disebabkan oleh pengaruh faktor lain yang tidak diperhitungkan dalam model dan kesalahan spesifikasi.

Dengan regresi linier berpasangan R 2 yx =r 2 yx .

Metode kuadrat terkecil

Metode kuadrat terkecil ( MNK, OLS, Kuadrat Terkecil Biasa) - salah satu metode dasar analisis regresi untuk memperkirakan parameter model regresi yang tidak diketahui dari data sampel. Metode ini didasarkan pada meminimalkan jumlah kuadrat dari residual regresi.

Perlu dicatat bahwa metode kuadrat terkecil itu sendiri dapat disebut metode untuk memecahkan masalah di area mana pun jika solusinya terdiri dari atau memenuhi kriteria tertentu untuk meminimalkan jumlah kuadrat dari beberapa fungsi dari variabel yang tidak diketahui. Oleh karena itu, metode kuadrat terkecil juga dapat digunakan untuk representasi perkiraan (perkiraan) dari fungsi yang diberikan oleh fungsi lain (yang lebih sederhana), ketika menemukan sekumpulan besaran yang memenuhi persamaan atau batasan, yang jumlahnya melebihi jumlah besaran ini. , dll.

Inti dari MNC

Biarkan beberapa model (parametrik) ketergantungan probabilistik (regresi) antara variabel (dijelaskan) kamu dan banyak faktor (variabel penjelas) x

di mana adalah vektor parameter model yang tidak diketahui

- Kesalahan model acak.Biarkan juga ada sampel pengamatan dari nilai-nilai variabel yang ditunjukkan. Membiarkan menjadi nomor pengamatan (). Kemudian adalah nilai-nilai variabel pada pengamatan ke-. Kemudian, untuk nilai parameter b yang diberikan, dimungkinkan untuk menghitung nilai teoretis (model) dari variabel yang dijelaskan y:

Nilai residual tergantung pada nilai parameter b.

Inti dari LSM (biasa, klasik) adalah untuk menemukan parameter seperti b yang jumlah kuadrat dari residual (eng. Jumlah Sisa Kuadrat) akan minimal:

Dalam kasus umum, masalah ini dapat diselesaikan dengan metode numerik optimasi (minimalisasi). Dalam hal ini, seseorang berbicara tentang kuadrat terkecil nonlinier(NLS atau NLLS - Bahasa Inggris. Kuadrat Terkecil Non Linier). Dalam banyak kasus, solusi analitis dapat diperoleh. Untuk menyelesaikan masalah minimisasi, perlu untuk menemukan titik stasioner dari fungsi dengan membedakannya terhadap parameter yang tidak diketahui b, menyamakan turunannya dengan nol, dan menyelesaikan sistem persamaan yang dihasilkan:

Jika kesalahan acak model terdistribusi normal, memiliki varians yang sama, dan tidak berkorelasi satu sama lain, estimasi parameter kuadrat terkecil sama dengan estimasi metode kemungkinan maksimum (MLM).

LSM dalam kasus model linier

Biarkan ketergantungan regresi linier:

Biarlah kamu- vektor kolom pengamatan variabel yang dijelaskan, dan - matriks pengamatan faktor (baris matriks - vektor nilai faktor dalam pengamatan tertentu, menurut kolom - vektor nilai faktor tertentu dalam semua pengamatan) . Representasi matriks dari model linier memiliki bentuk:

Maka vektor penduga dari variabel yang dijelaskan dan vektor residu regresi akan sama dengan

karenanya, jumlah kuadrat dari residual regresi akan sama dengan

Membedakan fungsi ini terhadap vektor parameter dan menyamakan turunannya dengan nol, kita memperoleh sistem persamaan (dalam bentuk matriks):

.Solusi dari sistem persamaan ini memberikan rumus umum untuk taksiran kuadrat terkecil untuk model linier:

Untuk tujuan analitis, representasi terakhir dari rumus ini ternyata bermanfaat. Jika data dalam model regresi terpusat, maka dalam representasi ini matriks pertama memiliki arti matriks kovarians sampel faktor, dan yang kedua adalah vektor kovarians faktor dengan variabel terikat. Jika, selain itu, datanya juga dinormalisasi di SKO (yaitu, pada akhirnya terstandarisasi), maka matriks pertama memiliki arti matriks korelasi sampel faktor, vektor kedua - vektor sampel korelasi faktor dengan variabel terikat.

Properti penting dari perkiraan LLS untuk model dengan konstanta- garis regresi yang dibangun melewati pusat gravitasi data sampel, yaitu persamaan terpenuhi:

Secara khusus, dalam kasus ekstrim, ketika satu-satunya regressor adalah konstanta, kami menemukan bahwa estimasi OLS dari parameter tunggal (konstanta itu sendiri) sama dengan nilai rata-rata dari variabel yang dijelaskan. Artinya, rata-rata aritmatika, yang dikenal karena sifat-sifat baiknya dari hukum bilangan besar, juga merupakan perkiraan kuadrat terkecil - memenuhi kriteria untuk jumlah minimum deviasi kuadrat darinya.

Contoh: regresi sederhana (berpasangan)

Dalam kasus regresi linier berpasangan, rumus perhitungan disederhanakan (Anda dapat melakukannya tanpa aljabar matriks):

Properti perkiraan OLS

Pertama-tama, kami mencatat bahwa untuk model linier, perkiraan kuadrat terkecil adalah perkiraan linier, sebagai berikut dari rumus di atas. Untuk perkiraan OLS yang tidak bias, perlu dan cukup untuk memenuhi kondisi paling penting dari analisis regresi: tergantung pada faktor-faktornya, ekspektasi matematis dari kesalahan acak harus sama dengan nol. Kondisi ini dipenuhi, khususnya, jika

- harapan matematis dari kesalahan acak adalah nol, dan

- faktor dan kesalahan acak adalah variabel acak independen.

Kondisi kedua - kondisi faktor eksogen - adalah fundamental. Jika properti ini tidak terpenuhi, maka kita dapat mengasumsikan bahwa hampir semua perkiraan akan sangat tidak memuaskan: mereka bahkan tidak akan konsisten (yaitu, bahkan sejumlah besar data tidak memungkinkan untuk memperoleh perkiraan kualitatif dalam kasus ini). Dalam kasus klasik, asumsi yang lebih kuat dibuat tentang determinisme faktor, berbeda dengan kesalahan acak, yang secara otomatis berarti bahwa kondisi eksogen terpenuhi. Dalam kasus umum, untuk konsistensi pendugaan, cukup untuk memenuhi kondisi eksogenitas bersama-sama dengan konvergensi matriks ke beberapa matriks non-singular dengan peningkatan ukuran sampel hingga tak terhingga.

Agar, selain konsistensi dan ketidakberpihakan, estimasi kuadrat terkecil (biasa) juga efektif (yang terbaik di kelas estimasi tak bias linier), properti tambahan dari kesalahan acak harus dipenuhi:

Asumsi ini dapat dirumuskan untuk matriks kovarians dari vektor kesalahan acak

Sebuah model linier yang memenuhi kondisi ini disebut klasik. Estimasi OLS untuk regresi linier klasik adalah estimasi yang tidak bias, konsisten dan paling efisien di kelas semua estimasi linier yang tidak bias (dalam literatur bahasa Inggris, singkatan kadang-kadang digunakan biru (Penaksir Tak Berbasis Linier Terbaik) adalah penduga tak bias linier terbaik; dalam literatur domestik, teorema Gauss-Markov lebih sering dikutip). Karena mudah ditunjukkan, matriks kovarians dari vektor penduga koefisien akan sama dengan:

Kuadrat terkecil yang digeneralisasikan

Metode kuadrat terkecil memungkinkan generalisasi yang luas. Alih-alih meminimalkan jumlah kuadrat dari residu, seseorang dapat meminimalkan beberapa bentuk kuadrat pasti positif dari vektor residual , di mana beberapa matriks bobot pasti positif simetris. Kuadrat terkecil biasa adalah kasus khusus dari pendekatan ini, ketika matriks bobot sebanding dengan matriks identitas. Seperti diketahui dari teori matriks simetris (atau operator), ada dekomposisi untuk matriks tersebut. Oleh karena itu, fungsi yang ditentukan dapat direpresentasikan sebagai berikut, yaitu, fungsi ini dapat direpresentasikan sebagai jumlah kuadrat dari beberapa "sisa" yang ditransformasikan. Dengan demikian, kita dapat membedakan kelas metode kuadrat terkecil - metode LS (Kuadrat Terkecil).

Terbukti (teorema Aitken) bahwa untuk model regresi linier umum (di mana tidak ada batasan yang dikenakan pada matriks kovarians kesalahan acak), yang paling efektif (di kelas estimasi tak bias linier) adalah estimasi yang disebut. OLS umum (OMNK, GLS - Kuadrat Terkecil Umum)- Metode LS dengan matriks bobot sama dengan matriks kovarians terbalik dari kesalahan acak: .

Dapat ditunjukkan bahwa rumus untuk pendugaan GLS dari parameter model linier memiliki bentuk

Matriks kovarians dari perkiraan ini, masing-masing, akan sama dengan

Faktanya, esensi OLS terletak pada transformasi (linier) (P) tertentu dari data asli dan penerapan kuadrat terkecil biasa pada data yang diubah. Tujuan dari transformasi ini adalah bahwa untuk data yang ditransformasi, kesalahan acak sudah memenuhi asumsi klasik.

Kuadrat terkecil berbobot

Dalam kasus matriks bobot diagonal (dan karenanya matriks kovarians kesalahan acak), kami memiliki apa yang disebut kuadrat terkecil tertimbang (WLS - Kuadrat Terkecil Tertimbang). Dalam hal ini, jumlah kuadrat dari residual model diminimalkan, yaitu, setiap pengamatan menerima "bobot" yang berbanding terbalik dengan varians kesalahan acak dalam pengamatan ini: . Faktanya, data ditransformasikan dengan pembobotan pengamatan (dibagi dengan jumlah yang sebanding dengan standar deviasi yang diasumsikan dari kesalahan acak), dan kuadrat terkecil normal diterapkan pada data berbobot.

Beberapa kasus khusus penerapan LSM dalam praktik

Pendekatan Linier

Pertimbangkan kasus ketika, sebagai hasil dari mempelajari ketergantungan besaran skalar tertentu pada besaran skalar tertentu (Ini dapat, misalnya, ketergantungan tegangan pada kekuatan arus: , di mana adalah nilai konstan, resistansi konduktor ), jumlah ini diukur, sebagai akibatnya diperoleh nilai dan nilai yang sesuai. Data pengukuran harus dicatat dalam sebuah tabel.

Meja. Hasil pengukuran.

| Pengukuran No. | ||

|---|---|---|

| 1 | ||

| 2 | ||

| 3 | ||

| 4 | ||

| 5 | ||

| 6 |

Pertanyaannya terdengar seperti ini: berapa nilai koefisien yang dapat dipilih untuk menggambarkan ketergantungan yang paling baik? Menurut kuadrat terkecil, nilai ini harus sedemikian rupa sehingga jumlah deviasi kuadrat dari nilai-nilai dari nilai-nilai

sangat minim

Jumlah deviasi kuadrat memiliki satu ekstrem - minimum, yang memungkinkan kita untuk menggunakan rumus ini. Mari kita cari nilai koefisien dari rumus ini. Untuk melakukan ini, kami mengubah sisi kirinya sebagai berikut:

Rumus terakhir memungkinkan kita untuk menemukan nilai koefisien , yang diperlukan dalam masalah.

Cerita

Sampai awal abad XIX. ilmuwan tidak memiliki aturan tertentu untuk memecahkan sistem persamaan di mana jumlah yang tidak diketahui kurang dari jumlah persamaan; Sampai saat itu, metode tertentu digunakan, tergantung pada jenis persamaan dan kecanggihan kalkulator, dan oleh karena itu kalkulator yang berbeda, mulai dari data pengamatan yang sama, sampai pada kesimpulan yang berbeda. Gauss (1795) dikreditkan dengan penerapan pertama metode ini, dan Legendre (1805) secara independen menemukan dan menerbitkannya dengan nama modernnya (fr. Metode des moindres quarres ) . Laplace menghubungkan metode ini dengan teori probabilitas, dan matematikawan Amerika Adrain (1808) mempertimbangkan aplikasi probabilistiknya. Metode ini tersebar luas dan ditingkatkan dengan penelitian lebih lanjut oleh Encke, Bessel, Hansen dan lain-lain.

Penggunaan alternatif MNC

Ide metode kuadrat terkecil juga dapat digunakan dalam kasus lain yang tidak terkait langsung dengan analisis regresi. Faktanya adalah bahwa jumlah kuadrat adalah salah satu ukuran kedekatan yang paling umum untuk vektor (metrik Euclidean dalam ruang dimensi hingga).

Salah satu aplikasinya adalah "menyelesaikan" sistem persamaan linier di mana jumlah persamaan lebih besar daripada jumlah variabel

dimana matriksnya bukan persegi, melainkan persegi panjang.

Sistem persamaan seperti itu, dalam kasus umum, tidak memiliki solusi (jika peringkat sebenarnya lebih besar dari jumlah variabel). Oleh karena itu, sistem ini dapat "dipecahkan" hanya dalam arti memilih vektor tersebut untuk meminimalkan "jarak" antara vektor dan . Untuk melakukan ini, Anda dapat menerapkan kriteria untuk meminimalkan jumlah perbedaan kuadrat dari bagian kiri dan kanan persamaan sistem, yaitu . Sangat mudah untuk menunjukkan bahwa solusi dari masalah minimasi ini mengarah ke solusi dari sistem persamaan berikut: